- はじめる前に

- アクセス権を管理する

- 基本情報

- Integrations

- プロセス アプリを使用する

- ダッシュボードとグラフを使用する

- プロセス グラフを使用する

- [プロセス モデルを検出] や [BPMN モデルをインポート] を使用する

- メニューを表示または非表示にする

- コンテキスト情報

- エクスポート

- フィルター

- UiPath® Automation Hub にオートメーションのアイデアを送信する

- タグ

- 期限日

- 比較

- 適合性チェック

- プロセス シミュレーション

- 根本原因分析 (プレビュー)

- 自動化の見込みをシミュレーションする

- Task Mining プロジェクトを Process Mining から開始する

- オートメーションをプロセス アプリからトリガーする

- プロセスのデータを表示する

- Process Insights (プレビュー)

- アプリを作成する

- データを読み込む

- データ変換中

- ダッシュボードをカスタマイズする

- プロセス アプリをパブリッシュする

- アプリ テンプレート

- 通知

- その他のリソース

Process Mining ユーザー ガイド

[ 直接接続を使用してデータをアップロード ] オプションは、ServiceNow ソース システムまたは Salesforce ソース システムを使用するプロセス固有のアプリ テンプレートと、ServiceNow または Salesforce への直接接続を設定する汎用アプリ テンプレートの [イベント ログ ] と [カスタム プロセス ] で利用できます。これは、直接接続が利用できるソース システムを使用するアプリ テンプレートでは既定のオプションです。

前提条件

[直接接続を使用してデータをアップロード] では、Integration Service のコネクションを使用します。つまり、以下が必要です。

- Integration Service のライセンス

- Integration Service がテナントで有効化されている

- Orchestrator および Orchestrator フォルダーへのアクセス

Integration Service のコネクションはフォルダーによって制限されます。特定のフォルダーからのコネクションを使用する場合、そのフォルダーを Process Mining に表示するには、Orchestrator でそのフォルダーへのアクセス権を持っている必要があります。Process Mining から新しいコネクションを作成した場合、そのコネクションは Orchestrator の個人用ワークスペース内に作成されます。

Integration Service のライセンスおよび Integration Service のコネクションについて詳しくは、『Integration Service ガイド』をご覧ください。

直接接続を設定する

CData Sync を使用してコネクションを設定するのではなく、「 データソースを選択する」の手順 で説明されているソース システムへの直接接続を使用して設定できます。

[直接接続を使用してデータをアップロード] オプションを使用すると、ソース システムからプロセス アプリにデータが直接読み込まれます。

ソース システムへの直接接続を設定するには、次の手順を実行します。

- [直接接続を使用してデータをアップロード] オプションを選択します。 アプリ テンプレートで使用されているソース システムが表示されます。

- [接続] を選択します。 新しいブラウザー タブが開き、コネクションの認証の詳細を入力できます。

注:

プロセス固有のアプリ テンプレートを使用している場合は、そのユーザー資格情報が、アプリ テンプレートで指定されたテーブルとフィールドの既定のリストにアクセスできることを確認してください。詳しくは、「 アプリ テンプレート 」をご覧ください。

入力テーブルをマッピングする

- 抽出された各テーブルのテーブルが [ ソース テーブル ] セクションに追加され、[ ターゲット テーブル ] セクションの関連する入力テーブルに自動的にマップされます。

- 各テーブルが正しいターゲット テーブルにマップされていることを確認します。必要に応じて、[ ターゲット テーブル ] リストから別のテーブルを選択し、マッピングを修正します。

- [次へ] を選択します。

必須テーブルとしてリストされていないテーブルをアップロードすると、アップロードされた各ファイルの [ソース テーブル ] セクションに新しいテーブルが自動的に追加され、対応する入力テーブルが [ターゲット テーブル ] セクションに作成されます。既定では、アップロードされたファイルのファイル名がテーブルの名前として使用されます。

テーブルのデータをアップロードする前にテーブルの設定が必要であることを示す警告メッセージが表示されます。新しいテーブルをアップロードすると、データ変換で使用できるようになります。ただし、このデータをダッシュボードに表示するには、さらに手順が必要です。まず、SQL クエリを使用してテーブルデータを読み込む必要があります。次に、このテーブルをプロセス アプリのデータ モデルに組み込む必要があります。データ モデルにテーブルを追加する方法について詳しくは、「 データ モデル 」をご覧ください。

入力テーブルを構成する

対象の入力テーブルの設定が自動的に検出されるので、あとは確認するだけです。

入力テーブルの設定を編集するには、以下の手順に従います。

- 構成するテーブルを見つけて [テーブルを編集] アイコン を選択します。これにより、選択したテーブルの [テーブルを編集 ] パネルが開きます。

- 必要に応じて設定を編集し、[ 保存] を選択します。

次の表では、テーブルの設定について説明します。

| 設定 | 説明 |

| テーブル名 | データ変換の入力テーブルの名前。 |

| 必須です。 | テーブルを必須として定義するオプション。 TRUEした場合、後でプロセス アプリをパブリッシュまたはインポートするときにこの表が必要になります。テーブルがアップロードされていない場合は、エラーがスローされます。オン FALSE 場合、アプリをパブリッシュまたはインポートする際に、この表は 省略可能 と見なされます。テーブルがアップロードされていない場合は、後続の SQL クエリが失敗しないように空のテーブルが作成されます。 |

| Autodetect | 入力ファイル内のフィールドの種類を識別し、検出されたフィールドの種類をターゲット テーブルの対応するフィールドに自動的に適用できます。 |

| エンコード | ファイルで使用されているエンコード。 |

| 区切り文字 | 各フィールドを区切る区切り文字です。 |

| 行の終わり | 行の終わりと新しい行の始まりを示すために使用される文字。 |

| 引用符文字 | フィールドが引用符で囲まれている場合に使用される引用符文字。 |

| エスケープ文字 | 特別な制御文字 (引用符や区切り文字など) として扱われる文字を正しく解釈するために使用されるエスケープ文字です。 注: 既定では、選択した 引用符文字 がエスケープ文字として使用されます。または、エスケープ文字としてバックスラッシュ (\) を選択することもできます。 |

| 読み込みの種類 | 表のロード・タイプ。 注: [読み込みの種類] として [増分] を選択した場合は、追加の設定を指定して、テーブルの増分読み込みを構成する必要があります。 |

データの増分読み込み

全ロードでは、最後のロード以降にデータが変更されたかどうか、または同じままであったかどうかに関係なく、すべてのデータがソースから抽出され、ターゲットシステムにロードされます。増分読み込みでは、最後の読み込み以降に変更 (追加または更新) されたデータのみが抽出されます。増分読み込みは、通常、全読み込みよりも高速でリソース消費が少なく、特に、小さなサブセットのみが頻繁に変更される可能性のある大量のデータを処理する場合に便利です。

テーブルの増分データ読み込みを有効にするには、テーブルの [読み込みの種類 ] を [増分] に設定する必要があります。増分読み込みには、データが正しく読み込まれるようにするための一意の識別子と、ソース データの変更を追跡するためのフィールド (タイムスタンプやバージョンなど) が必要です。

次の表で、 増分 読み込みに必要な追加設定について説明します。

| 設定 | 説明 |

| 主キー | 主キー フィールドまたはデータ ソース内の各レコードを一意に識別するフィールド。 |

| タイムスタンプ フィールド | 各レコードが最後に更新または追加された日時を追跡するために使用されるフィールドです。 |

| タイムスタンプの形式 | [タイムスタンプ] フィールドで使用されるタイムスタンプ値の形式です。 |

データの読み込みに使用する抽出方法では、増分抽出のために追加または特定の設定が必要になる場合があります。CData Sync の増分抽出の設定方法について詳しくは、「 CData Sync を使用してデータを読み込む 」をご覧ください。Theobald Xtract Universal の増分抽出の設定方法について詳しくは、「 Theobald Xtract Universal を使用してデータを読み込む 」をご覧ください。DataUploader で増分抽出を設定する方法について詳しくは、「 DataUploader を使用してデータを読み込む 」をご覧ください。読み込みの種類を [完全] に戻す場合は、適切な抽出方法を設定してください。

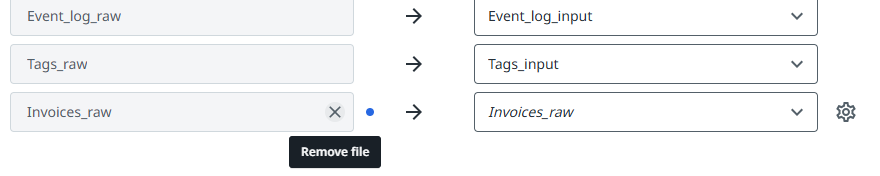

ソース・ファイルの削除

ソースデータのアップロード時に誤ってソースファイルを選択してしまった場合は、[入力データ]画面から削除できます。

ソース ファイルは、データがアップロードされていない場合にのみ削除できます。

ソース ファイルを削除するには、以下の手順に従います。

- [ソース テーブル] リストで、削除するソース ファイルを見つけます。

- 表の上にマウスをホバーし、[ ファイルを削除] を選択します。

入力ファイルが削除されます。

入力テーブルを削除する

以前にアップロードした入力テーブルは、[入力データ] 画面の [テーブルのマッピング] ページから直接削除できます。入力テーブルを削除すると、プロセス アプリのデータが削除されます。後でプロセス アプリでデータを使用する場合は、入力テーブルを再アップロードする必要があります。

テーブルを削除すると、データ変換が失敗する可能性があります。

テーブルを削除するには、以下の手順に従います。

- 削除するテーブルを見つけて、[テーブルを削除] アイコン を選択します。確認のメッセージが表示されます。

- [削除] を選択します。

入力フィールドのマッピング

選択したテーブルについて、テーブルの必須入力フィールドが [ フィールド ] ページの [必須フィールド] セクションに表示されます。

入力テーブルで検出されたソース フィールドは、ターゲット テーブルの対応するフィールドに自動的にマッピングされます。

- 各フィールドが正しいターゲット フィールドにマッピングされていることを確認します。必要に応じて、[ 対象フィールド ] リストから別のフィールドを選択し、マッピングを修正します。

- [次へ] を選択して続行します。

入力フィールドを設定する

対象入力欄の設定は自動検出されるので、あとは確認するだけです。

入力フィールドの設定を編集するには、以下の手順に従います。

- 設定するフィールドを見つけて [フィールドを編集] アイコン を選択し、選択したフィールドの [フィールドを編集 ] パネルを開きます。

- 必要に応じて設定を編集し、[ 保存] を選択します。

次の表では、テーブルの設定について説明します。

| 設定 | 説明 |

| 名前 | フィールドの名前です。 注: [名前] は必須フィールドです。 |

| Autodetect | 入力ファイル内のフィールドの種類を識別し、検出されたフィールドの種類をターゲット テーブルのフィールドに自動的に適用できます。 |

| 入力 | フィールドのデータ型です。

注: フィールドの種類によっては、解析設定を指定してフィールドを構成する必要があります。 |

| 必須です。 | フィールドを必須として定義するオプション。 選択すると、プロセス アプリをパブリッシュまたはインポートするときにこのフィールドが必須になります。フィールドがない場合はエラーがスローされます。選択しない場合、このフィールドは任意と見なされます。これがない場合、フィールドは NULL 値で追加され、後続の SQL クエリは失敗しません。 |

| 一意 | フィールド値を定義するオプション: レコードごとに個別の値または一意の値を設定します。 |

| null ではない | フィールドが各レコードに対して値を持つ必要があることを定義するオプション。フィールドを空のままにしたり、NULL 値を入力したりすることはできません。 |

フィールド型の解析設定

次の表では、さまざまなフィールドの種類で使用できる解析設定について説明します。

| フィールドの種類 | 解析の設定 |

| Integer | 3 桁の区切り文字

|

| Decimal |

|

| Boolean |

注: True 値 と False 値は 必須の設定であり、異なる値である必要があります。 |

| 日付 | 日付形式 ( 「日付形式の解析設定の例 」をご覧ください)。 |

| Datetime | 日付/時刻形式 日付形式 ( 「日時形式の解析設定の例 」をご覧ください。) |

日付形式の解析設定例

| 形式 | 例 |

|---|---|

yyyy-mm-dd | 2025-04-05 2025-4-5 |

mm/dd/yy | 04/05/25 4/5/25 |

mm/dd/yyyy | 04/05/2025 4/5/2025 |

mm-dd-yyyy | 04-05-2025 4-5-2025 |

dd-mm-yyyy | 05-04-2025 5-4-2025 |

yyyy/mm/dd | 2025/04/05 |

DateTime 形式の解析設定の例

| 形式 | 例 |

|---|---|

yyyy-mm-dd hh:mm:ss[.nnn] | 2025-04-05 14:30:45.123 2025-4-5 14:30:45.123 |

yyyy/mm/dd hh:mm:ss[.nnn] | 2025/04/05 14:30:45.123 2025/4/5 14:30:45.123 |

mm/dd/yyyy hh:mm:ss[.nnn] | 04/05/2025 14:30:45.123 4/5/2025 14:30:45.123 04/05/2025 14:30:45 4/5/2025 14:30:45 |

yyyy-mm-ddThh:mm:ss[.nnn] | 2025-04-05T14:30:45.123 2025-4-5T14:30:45.123 |

mm-dd-yyyy hh:mm:ss[.nnn] | 04-05-2025 14:30:45.123 4-5-2025 14:30:45.123 04-05-2025 14:30:45 4-5-2025 14:30:45 |

dd-mm-yyyy hh:mm:ss[.nnn] | 05-04-2025 14:30:45.123 5-4-2025 14:30:45.123 05-04-2025 14:30:45 5-4-2025 14:30:45 |

yyyy-mm-ddThh:mm:ss[.nnn]+00:00* | 2025-04-05T14:30:45.123+02:00 2025-04-05T14:30:45-03:00 2025-04-05T14:30:45 2025-4-5T14:30:45.123+02:00 2025-4-5T14:30:45-03:00 2025-4-5T14:30:45Z |

yyyy-mm-ddThh:mm:ss[.nnn]+0000* | 2025-04-05T09:30:00+0000 2025-04-05T09:30:00.123+0000 |

yyyy-mm-dd hh:mm:ss[.nnn]+00:00* | 2025-04-05 09:30:00+00:00 2025-04-05 09:30:00.123+00:00 |

yyyy-mm-dd hh:mm:ss[.nnn]+0000* | 2025-04-05 09:30:00+0000 2025-04-05 09:30:00.123+0000 |

dd/mm/yyyy hh:mm:ss[.nnn] | 05/04/2025 14:30:45.123 5/4/2025 14:30:45.123 |

mm/dd/yy hh:mm:ss[.nnn] AM/PM | 04/05/25 02:30:45 PM 4/5/25 02:30:45 PM |

*) タイム ゾーン情報を含むタイムスタンプは、データの取り込み時に自動的に UTC に変換されます。