- Bevor Sie beginnen

- Erste Schritte

- Integrationen

- Arbeiten mit Prozess-Apps

- Arbeiten mit Dashboards und Diagrammen

- Arbeiten mit Prozessdiagrammen

- Arbeiten mit Discover-Prozessmodellen und Import BPMN-Modellen

- Anzeigen oder Ausblenden des Menüs

- Kontextinformationen

- Exportieren

- Filter

- Senden von Automatisierungsideen an den UiPath® Automation Hub

- Tags

- Fälligkeitsdaten

- Vergleichen

- Konformitätsprüfung

- Ursachenanalyse

- Simulation des Automatisierungspotenzials

- Auslösen einer Automatisierung über eine Prozess-App

- Anzeigen von Prozessdaten

- Erstellen von Apps

- Laden von Daten

- Anpassen von Prozess-Apps

- Einführung in Dashboards

- Arbeiten mit dem Dashboard-Editor

- Dashboards erstellen

- Dashboards

- Automatisierungsmanager

- Definieren neuer Eingabetabellen

- Hinzufügen von Feldern

- Hinzufügen von Tabellen

- Anforderungen an das Datenmodell

- Anzeigen und Bearbeiten des Datenmodells

- Exportieren und Importieren von Transformationen

- Anzeigen des Transformationsprotokolls

- Bearbeiten und Testen von Datentransformationen

- Struktur von Transformationen

- Tipps zum Schreiben von SQL

- Zusammenführen von Ereignisprotokollen

- Prozessmanager

- Dashboards veröffentlichen

- App-Vorlagen

- Zusätzliche Ressourcen

- Vorgefertigte Tags und Fälligkeitsdaten

- Bearbeiten von Datentransformationen in einer lokalen Umgebung

- Setting up a local test environment

- Entwerfen eines Ereignisprotokolls

- DataBridgeAgent

- Systemanforderungen

- Konfigurieren des DataBridgeAgent

- Hinzufügen eines benutzerdefinierten Connectors zu DataBridgeAgent

- Verwenden von DataBridgeAgent mit dem SAP Connector für den Purchase-to-Pay Discovery Accelerator

- Verwenden von DataBridgeAgent mit dem SAP Connector für den Order-to-Cash Discovery Accelerator

- Erweitern des Extraktionstools SAP Ariba

- Leistungsmerkmale

- So wird eine Datenausführung von der Datenbank abgebrochen

- So fügen Sie eine IP-Tabellenregel hinzu, um den SQL Server-Port 1433 zu verwenden

- Beim Erstellen einer Prozess-App bleibt der Status in „App wird erstellt“.

- Konfigurieren von Dapr mit Redis im Clustermodus

- Datentransformationen

- Hochladen von Daten

- CData-Synchronisierung

Process Mining-Benutzerhandbuch

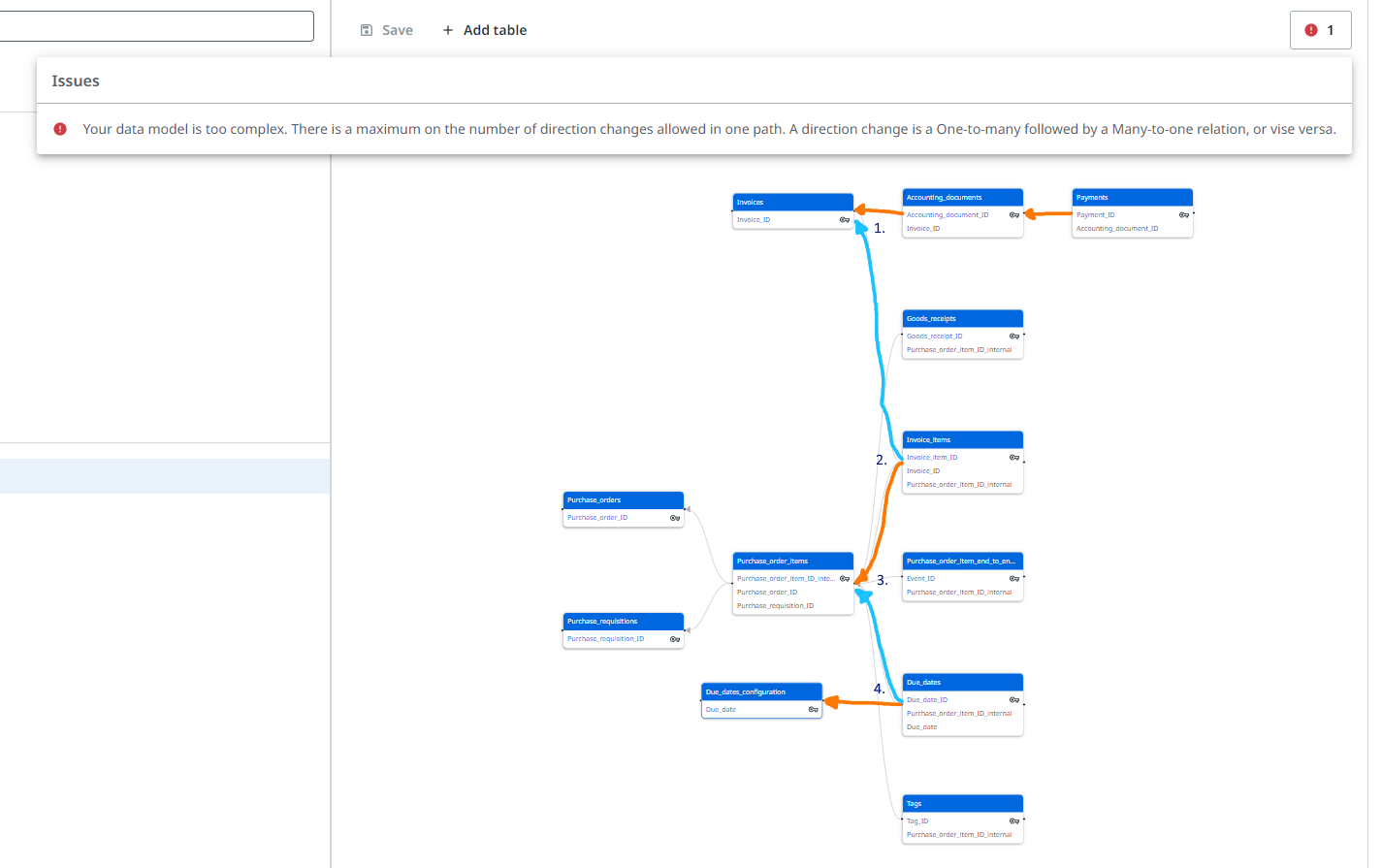

Ein Datenmodell kann nur gespeichert werden, wenn es die folgenden Anforderungen erfüllt:

-

Das Datenmodell enthält höchstens 40 Tabellen.

-

Alle Tabellen sind mit dem gesamten Datenmodell verbunden.

-

Es gibt keine Zirkelbeziehungen im Datenmodell.

-

Maximal 15 Richtungsänderungen sind in einem Beziehungspfad zulässig.

Tipp:Eine Richtungsänderung ist eine 1:n-Beziehung, gefolgt von einer n:1-Beziehung oder umgekehrt.

Erforderliche Ausgabetabellen

Ein Datenmodell muss über eine Cases -, Event_log -, Tags - und Due_dates -Tabelle verfügen.

Je nach App-Vorlage hat die Tabelle Cases einen prozessspezifischen Namen, z. B. Purchase_order_items oder Incidents.

Die Tabellen Cases, Event_log, Tags und Due_dates müssen die folgenden Ausgabefelder haben.

Alle Felder müssen ausgefüllt werden. Einige Felder dürfen jedoch nur NULL-Werte enthalten.

| Tabelle | Erforderliches Ausgabefeld |

|---|---|

Cases | Case_ID* |

Event_log | Case_ID* |

Event_start | |

Event_end | |

Activity | |

Activity_order | |

Automated | |

Event_cost | |

Event_processing_time | |

Tags | Tag_ID |

Case_ID* | |

Tag | |

Tag_type | |

Due_dates | Case_ID* |

Due_date | |

Due_date_type | |

Actual_date | |

Expected_date | |

On_time | |

Cost | |

Difference |

*) Je nach App-Vorlage kann Case_ID unterschiedlich aufgerufen werden, z. B. Purchase_order_item_ID oder Incident_ID.