- Démarrage

- Gestion de projet

- Documents

- Travailler avec l’analyse de l’impact des modifications

- Créer des scénarios de test

- Affectation de cas de test aux exigences.

- Clonage des cas de test

- Exporter des cas de test

- Lier des cas de test à Test Manager dans Studio

- Delete test cases

- Cas de test manuels

- Importer des cas de test manuels

- Documenter les cas de test avec Task Capture

- Paramètres

- Activation de la gouvernance au niveau du projet

- Désactivation de la gouvernance au niveau du projet

- Activation de la gouvernance au niveau des cas de test

- Désactivation de la gouvernance au niveau du cas de test

- Gérer les approbateurs pour les cas de test régis

- Gérer les cas de test régis à l’état En cours

- Gérer les cas de test régis à l’état En révision

- Gérer les objets régis à l'état Signé

- Gérer les commentaires pour les cas de test régis

- Appliquer des filtres et des vues

- Importer des ensembles de test Orchestrator

- Creating test sets

- Ajouter des cas de test à un ensemble de test

- Attribuer des utilisateurs par défaut dans l'exécution de l'ensemble de tests

- Activation de la couverture des activités

- Activer Healing Agent

- Configuration d'ensembles de test pour des dossiers et des robots d'exécution spécifiques

- Remplacer les paramètres

- Cloner des ensembles de tests

- Exporter des ensembles de tests

- Appliquer des filtres et des vues

- FAQ - Parité des fonctionnalités - Test Manager vs Orchestrator

- Exécution de tests manuels

- Exécuter des tests automatisés

- Exécuter des cas de test sans ensemble de tests

- Exécuter des tests mixtes

- Créer des exécutions en attente

- Appliquer un ordre d’exécution

- Réexécution des exécutions de test

- Planification des exécutions

- Résoudre les problèmes des exécutions automatisées

- Tests d'accessibilité pour Test Cloud

- Rechercher avec Autopilot

- Opérations et utilitaires de projet

- Paramètres de Test Manager

- Intégration de l'outil de gestion du cycle de vie des applications (ALM)

- Intégration de l'API

- Résolution des problèmes

Guide de l'utilisateur de Test Manager

Prérequis

La disponibilité des fonctionnalités dépend de la plateforme Cloud que vous utilisez. Pour des détails, reportez-vous à la page Disponibilité de la fonctionnalité Test Manager.

Pour activer les rapports avec Insights, procédez comme suit :

- Activez le service Insights sur le même locataire que votre instance Test Manager. Vous avez besoin d'un rôle d'administrateur d'organisation Automation Cloud pour activer un service.

- Dans Test Manager, activez le paramètre Activer la création de rapports avec Insights au niveau du locataire. Vous avez besoin d'un rôle de locataire Administrateur Test Manager pour activer l'intégration avec Insights. Pour plus d'informations sur l'activation du paramètre, consultez Paramètres au niveau du locataire.

Vue d'ensemble (Overview)

Une fois que vous avez activé l'intégration d'Insights dans votre locataire Test Manager, vous pourrez accéder aux analyses pour tous vos projets de test au sein de ce locataire. Insights récupère des données de Test Manager basées sur un modèle de données spécifique et les présente via le tableau de bord prédéfini du rapport d'exécution de Test Manager . Ce tableau de bord fournit un aperçu de toutes vos exécutions de test au sein de votre locataire.

Graphique 1. Tableau de bord du rapport d’exécution de Test Manager

Lorsque vous activez la création de rapports avec Insights, les données de tous les projets Test Manager sont chargées vers Insights. Par conséquent, tous les utilisateurs ayant accès à Insights pourront générer des rapports liés à ces projets, indépendamment des autorisations dont ils disposent dans Test Manager.

Modèle de données

Insights utilise les journaux de cas de test de Test Manager pour générer des tableaux de bord personnalisables. Pour de plus amples informations sur le modèle de données utilisé par Insights pour générer les tableaux de bord, consultez la section Modèle de données de Test Manager .

Dans le modèle de données de Test Manager, les journaux de cas de test contiennent deux types de résultats: techniques et fonctionnels. Ces résultats sont généralement identiques, sauf si une erreur technique apparaît au cours de l'exécution. Les erreurs techniques peuvent inclure les interruptions d'infrastructure, les erreurs d'automatisation ou d'autres déclencheurs non fonctionnels. Dans l'un de ces scénarios, les résultats techniques labelliseront le test comme ayant échoué. Les résultats fonctionnels sont destinés à refléter uniquement le résultat des vérifications métier. Par conséquent, ils n'indiquent aucun résultat en cas d'erreurs en raison de l'absence de résultats fiables.

Création de tableaux de bord Insights basés sur des champs personnalisés

Vous pouvez créer des tableaux de bord Insights pour les exigences et les ensembles de tests basés sur les champs personnalisés associés à ces objets de données.

Vous pouvez travailler avec un maximum de 5 sélecteurs de champs personnalisés et 5 dimensions.

- Connectez-vous à votre plate-forme et accédez à Insights.

- Accédez à Tableaux de bord et ajoutez un tableau de bord.

- Ouvrez le tableau de bord et sélectionnez Modifier le tableau de bord.

- Pointez la barre d'outils et sélectionnez Ajouter.

Figure 2. Ajouter un tableau de bord Insights

-

Sélectionnez Visualisation.

-

Sous Test Manager, sélectionnez l’objet de données pour lequel vous souhaitez créer un tableau de bord. Par exemple, sélectionnons Exigences.

-

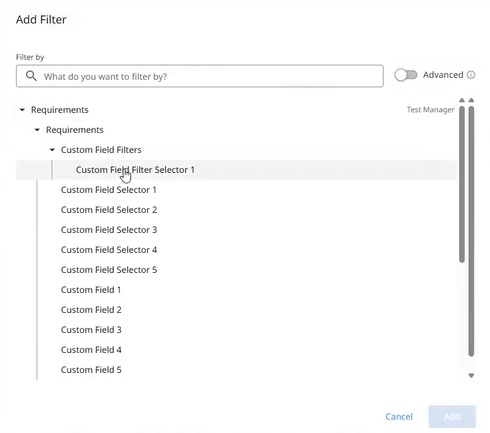

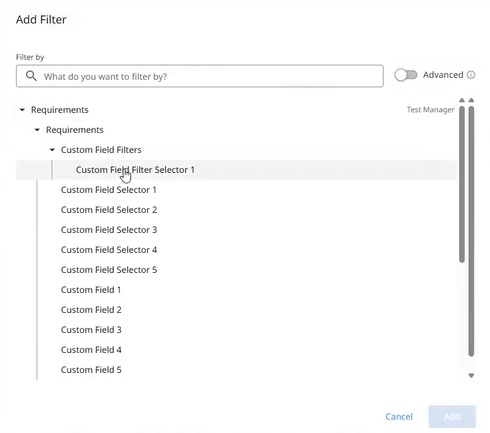

Développez la catégorie d’objet de données. Pour notre exemple, développez Exigences. Notez que vous pouvez avoir un maximum de 5 sélecteurs de champs personnalisés (répertorés comme Sélecteur de champs personnalisés 1 et ainsi de suite, sous Champs à filtre uniquement) et 5 dimensions (répertoriées comme Champ personnalisé 1 et ainsi, sous Dimensions). Il y a une correspondance 1:1 entre les 5 sélecteurs de champ personnalisé et les 5 dimensions de champ personnalisé. Par exemple, le Sélecteur de champ personnalisé 1 correspond au Champ personnalisé 1.

-

Dans Filtrer uniquement les champs, sélectionnez un ou plusieurs sélecteurs de champ personnalisé.

Figure 3. Sélection de champ personnalisé

- Développez la liste déroulante pour voir tous les champs personnalisés disponibles dans le locataire pour votre objet de données. L'exemple ci-dessous montre les champs personnalisés disponibles dans l'exemple de locataire, selon les exigences.

Figure 4. Valeurs de champ personnalisé

-

Sélectionnez les valeurs de champ personnalisé pour vos sélecteurs de champ personnalisé.

-

Dans Dimensions, sélectionnez les champs personnalisés. Par exemple, sélectionnez Champ personnalisé 1, Champ personnalisé 2 et Champ personnalisé 3.

-

Dans les filtres de champ personnalisé, sélectionnez les valeurs dont vous avez besoin. Par exemple, sélectionnez Nom et Nom du projet.

-

Dans Mesures, sélectionnez les valeurs dont vous avez besoin. Pour cet exemple, sélectionnez Nombre total de cas de test.

-

Les valeurs que vous avez sélectionnées sont affichées sur le côté droit, dans l'éditeur d'espace de travail.

Figure 5. Mesures

15. Dans le coin supérieur droit de l'espace de travail, sélectionnez Exécuter.

Image 6. Exécuter un tableau de bord

16. Attendez le chargement des données. Les données peuvent être visualisées dans plusieurs formats: tableau, graphique ou graphique.

-

(Facultatif) Triez vos données par colonne. Par exemple, triez vos données par priorité.

-

Dans le coin supérieur droit de l'éditeur d'espace de travail, sélectionnez Enregistrer.

-

Sélectionnez l'icône en forme de crayon ou cliquez à l'intérieur du nom de la table pour donner un nom officiel à votre tableau de bord. Dans notre exemple, nous avons nommé le tableau de bord « Champ personnalisé pour l'exigence ».

-

Redimensionnez la table en faisant glisser ses bords.

-

Depuis le menu de la barre d'outils, ajoutez un filtre pour votre tableau de bord.

-

Sélectionnez Filtres > Ajouter un filtre.

-

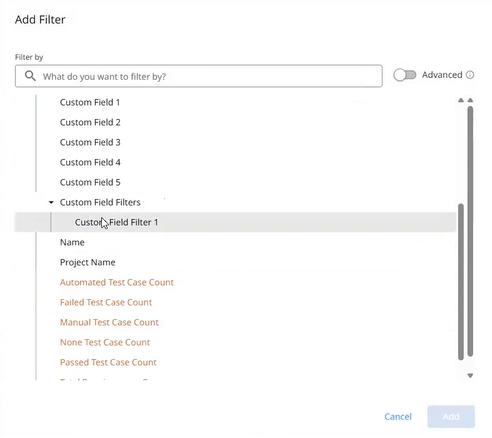

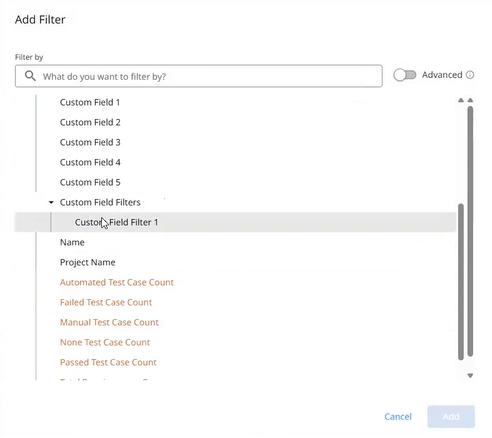

Ajoutez des filtres pour votre objet de données, dans notre cas Exigences. Développez l'objet de données (Exigences), développez les Filtres de champs personnalisés et choisissez un sélecteur (par exemple, Sélecteur de filtre de champ personnalisé 1).

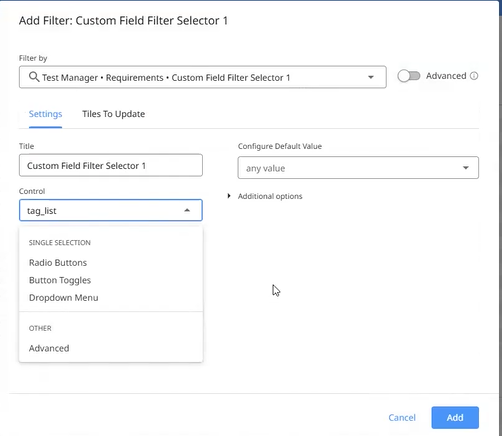

Figure 7. Filtres

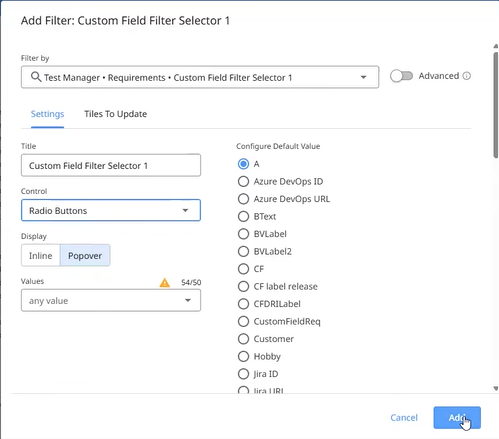

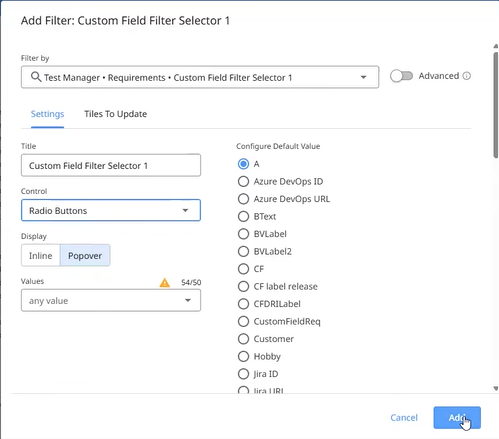

24. Dans la boîte de dialogue Ajouter un filtre , continuez à configurer votre filtre (titre, contrôle, valeur par défaut), puis sélectionnez Ajouter. Pour cet exemple, nous avons choisi un bouton radio.

Figure 8. Ajouter un filtre

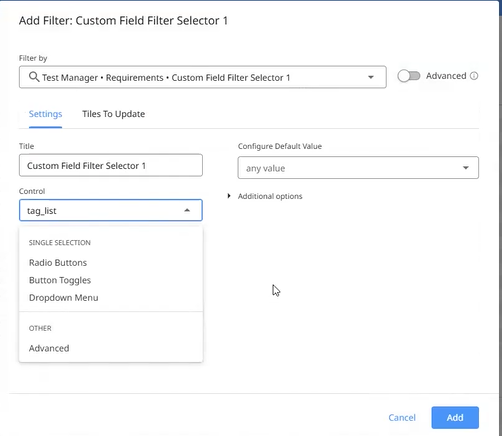

25. Développez à nouveau l'objet de données (Exigences) et choisissez la valeur du sélecteur. Pour cet exemple, nous avons sélectionné Filtres de champ personnalisé > Filtre de champ personnalisé 1.

Figure 9. Filtre de champ personnalisé

26. Dans la boîte de dialogue Ajouter un filtre , continuez la configuration (titre, contrôle, options de filtre) et sélectionnez Ajouter. Pour notre exemple, nous avons choisi Avancé dans le champ Contrôle et est n'importe quelle valeur du champ Configurer la valeur par défaut .

Image 10. Configuration du filtre

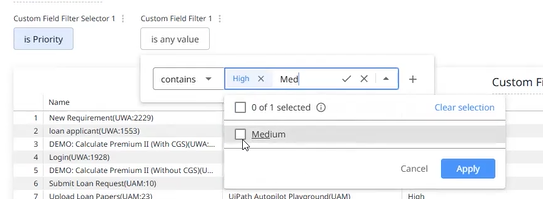

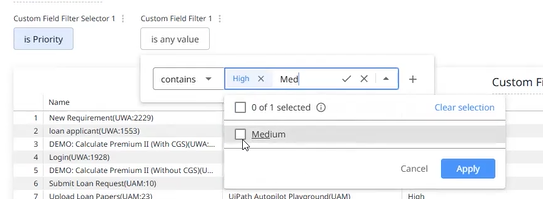

27. Dans votre tableau de bord, vérifiez le filtre que vous avez ajouté. Pour cet exemple, nous avons ajouté le Sélecteur de filtre de champ personnalisé 1 et le Filtre de champ personnalisé 1. Sous le premier filtre, développez le menu est , sélectionnez une valeur (Priorité) et sélectionnez Appliquer. Sous le deuxième filtre, développez le menu correspond à n'importe quelle valeur , sélectionnez un opérateur et une valeur (contient Élevée ou Moyenne) et sélectionnez Appliquer.

Image 11. Valeurs de filtre

28. Sélectionnez le bouton Actualiser dans le coin supérieur droit de l'éditeur d'espace de travail.

Modèle de données de Test Manager

Termes et concepts

La structure du modèle de données de Test Manager repose sur les concepts suivants :

| Concept | Description |

|---|---|

| Explorer | Le point de départ de l'exploration. Les données sont réaffichées via des Explorations, qui peut être considéré comme une entité générale correspondant aux champs qu'elle contient. |

| Consultation (View) | Une vue représente une table de données, que cette table soit native de votre base de données ou qu'elle ait été créée à l'aide de la fonctionnalité de table dérivée de Looker. Dans chaque vue se trouvent des définitions de champ, dont chacune correspond généralement à une colonne de la table sous-jacente ou à un calcul dans Looker. |

| Cote | Dans le cadre d'une vue dans l'exploration, la dimension est un champ pouvant être groupé et peut être utilisée pour filtrer les résultats de la requête. Il peut s'agir de l'un des éléments suivants :

|

| Mesure | Dans le cadre d'une vue dans l'exploration, le paramètre Mesure déclare une nouvelle mesure (agrégation) et spécifie un nom pour cette mesure. integer , string . |

Dimensions et mesures

La disponibilité des fonctionnalités dépend de la plateforme Cloud que vous utilisez. Pour des détails, reportez-vous à la page Disponibilité de la fonctionnalité Test Manager.

Les dimensions et mesures des exigences, des ensembles de test et des exécutions de test sont disponibles dans Test Manager uniquement lorsqu'elles sont fournies via Test Cloud.

Journaux de cas de test

Les tableaux suivants décrivent les dimensions et les mesures disponibles pour les journaux de cas de test.

| Cote | Saisie de texte | Description |

|---|---|---|

| Adresse e-mail du bénéficiaire | string | L’adresse e-mail de l’utilisateur auquel un cas de test a été affecté. |

| Nom du projet d’automatisation | string | Le nom de l'automatisation liée au cas de test. |

| Date dʹéchéance | Date | La date à laquelle un cas de test manuel était planifié pour avoir été exécuté. |

| Démarrage de l’exécution | Date | La date à laquelle l'exécution du test a commencé. |

| Exécuté par | string | Le nom d'utilisateur ou le nom du robot qui a exécuté le test. |

| Fin d'exécution (Execution End) | Date | La date à laquelle l'exécution du test s'est terminée. |

| ExecutionType | string | Le type d'exécution :

|

| Nom de la machine hôte | string | Nom de la machine. |

| Project Name | string | Nom du projet Test Manager. |

| Préfixe du projet | string | Le préfixe du projet Test Manager. |

| Date de signalement | Date | La date à laquelle le test a été exécuté. C'est une date sans heure et aussi sans fuseau horaire. |

| Résultat | string | Le résultat du cas de test : Réussi, Échec ou Aucun. |

| Nom du Robot (Robot Name) | string | Le nom du Robot qui a exécuté le test. |

| Nom de l’exécution de test | string | Le nom de l'exécution de test. |

Table 2. Mesures des journaux de cas de test

| Mesures | Saisie de texte | Description |

|---|---|---|

| Nombre total | Integer | Le nombre total de journaux de cas de test. |

| Nombre de réussites | string | Le nombre de journaux de cas de test réussis. |

| Nombre d’échecs (technique) | Integer | Les résultats techniques indiquent les résultats comme ayant échoué lorsqu’une exception se produit lors de l’exécution. |

| Nombre sans résultat (technique) | Integer | Les résultats techniques indiquent aucun résultat lorsqu’une exception se produit lors de l’exécution. |

| DurationInSeconds | Integer | Durée totale d'exécution en secondes. |

Prérequis

Les tableaux suivants répertorient les dimensions et mesures disponibles pour les exigences.

Tableau 3. Dimensions des exigences

| Cote | Saisie de texte | Description |

|---|---|---|

| Project Name | string | Une combinaison du nom du projet et du préfixe du projet visant à le rendre unique et à augmenter la lisibilité. |

| Nom | string | Une combinaison entre la clé de l'exigence et son nom, visant à la rendre unique et à augmenter la lisibilité. |

Tableau 4. Mesures d’exigence

| Mesure | Saisie de texte | Description |

|---|---|---|

| Nombre total de cas de test | Integer | Le nombre de cas de test affectés à un prérequis. |

| Nombre de cas de test automatisés | Integer | Le nombre de cas de test automatisés affectés à un prérequis. |

| Nombre de cas de test manuels | Integer | Le nombre de cas de test manuels affectés à un prérequis. |

| Nombre de cas de test réussis | Integer | Le nombre de cas de test affectés à une exigence ayant réussi lors de la dernière exécution de test. |

| Nombre de cas de test ayant échoué | Integer | Le nombre de cas de test affectés à une exigence ayant échoué lors de la dernière exécution de test. |

| Aucun nombre de cas de test | Integer | Le nombre de cas de test affectés à une exigence sans résultat lors de la dernière exécution de test. |

| Nombre total d’exigences | Integer | Le nombre total d’exigences. |

Ensembles de tests

Les tableaux suivants décrivent les dimensions et les mesures disponibles pour les ensembles de test.

Pour les cas de test attribués, la vue Ensemble de tests contient des informations sur les affectations de test statiques.

Tableau 5. Dimensions de l’ensemble de tests

| Cote | Saisie de texte | Description |

|---|---|---|

| Project Name | string | Une combinaison du nom du projet et du préfixe du projet visant à le rendre unique et à augmenter la lisibilité. |

| Nom | string | Une combinaison du nom du projet et du préfixe du projet visant à le rendre unique et à augmenter la lisibilité. |

| Nom de robot | string | Le nom du Robot qui a exécuté l’ensemble de test. |

| Source | string | La source de l’ensemble de tests : Orchestrator ou Test Manager. |

Tableau 6. Mesures de l’ensemble de tests

| Mesure | Saisie de texte | Description |

|---|---|---|

| Nombre total d’ensembles de tests | Integer | Le nombre d’ensembles de tests. |

| Nombre de cas de test automatisés | string | Le nombre de cas de test automatisés dans l’ensemble de tests. |

| Nombre de cas de test manuels | Integer | Nombre de cas de test manuels dans l’ensemble de test. |

Exécution de test

Le tableau suivant détaille les dimensions et mesures disponibles pour les exécutions de test.

Tableau 7. Dimensions des exécutions de test

| Cote | Saisie de texte | Description |

|---|---|---|

| Project Name | string | Une combinaison entre le préfixe et le nom du projet pour le rendre unique et augmenter la lisibilité. |

| Nom | string | Une combinaison d'ID d'exécution et de nom pour le rendre unique et augmenter la lisibilité. |

| Nom de l’ensemble de tests | string | Une combinaison clé/nom d'ensemble de test pour le rendre unique et améliorer la lisibilité. |

| Type d’exécution | string | Type d’exécution : Manuel, Automatisé, Aucun ou Mixte. |

| Source | string | Source de l'exécution : TestManager, Orchestrator ou Studio. |

Table 8. Mesures d’exécution de test

| Mesure | Saisie de texte |

|---|---|

| Nombre total d’exécutions de tests | Integer |

| Nombre de types d’exécutions manuelles | Integer |

| Nombre de types d’exécutions automatisées | Integer |

| Nombre de types d’exécutions mixtes | Integer |

| Durée en secondes de l’exécution du test | Integer |