- Erste Schritte

- UiPath Agents in Studio Web

- Über UiPath Agents

- Lizenzierung

- Ausführung von Agents

- Agents und Workflows

- Bewährte Verfahren zum Erstellen von Agents

- Auswahl des besten Modells für Ihren Agenten

- Best Practices für das Veröffentlichen und Bereitstellen von Agents

- Bewährte Verfahren für Kontext-Engineering

- Best Practices für DeepRAG und Batch-Transformation: JIT vs. indexbasierte Strategien

- Aufforderungen

- Arbeiten mit Dateien

- Kontexte

- Eskalationen und Agent-Speicher

- Bewertungen

- Spuren von Agents

- Agent-Punktzahl

- Verwaltung von UiPath Agents

- Codierte UiPath Agents

Benutzerhandbuch zu Agents

Mithilfe von Evaluierungen können Sie sicherstellen, dass sich Ihr Conversational Agent über verschiedene Dialogpfade hinweg zuverlässig verhält. Auf dieser Seite wird beschrieben, wie Sie Ihren Agent mit Debug-Chat testen, Bewertungssätze erstellen und automatisierte Tests ausführen.

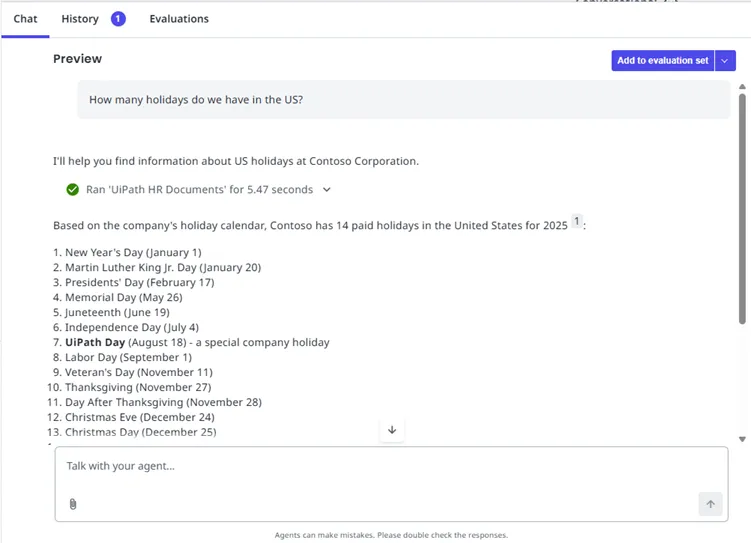

Debug-Chat

Debug-Chat bietet eine Testumgebung in Echtzeit, in der Sie mit Ihrem Agent interagieren und sein Verhalten überprüfen können.

Starten einer Debug-Sitzung

- Öffnen Sie in Studio Web Ihren Conversational Agent.

- Wählen Sie Debug, um die Chatoberfläche zu öffnen.

- Senden Sie Nachrichten, um die Antworten Ihres Agenten zu testen.

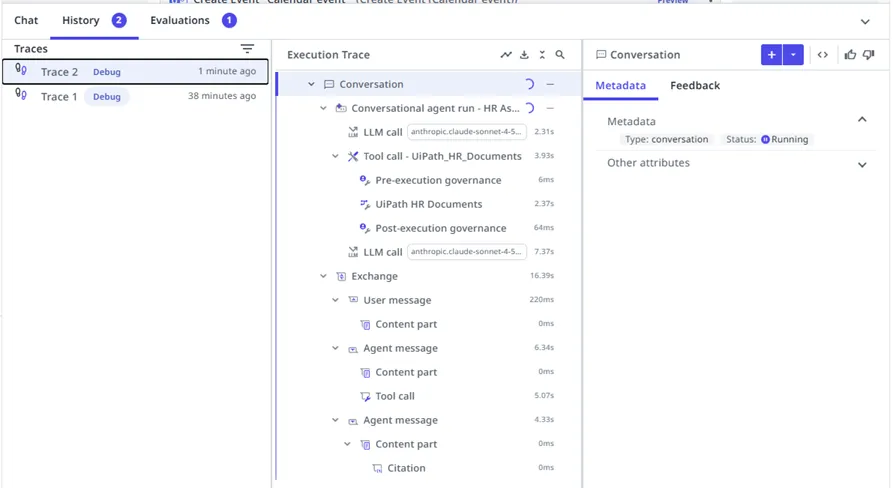

Anzeigen von Ausführungsspuren

Der Verlaufsbereich zeigt Echtzeitdetails zur Ausführung des Agents an:

- LLM-Aufrufe: Die Eingabeaufforderungen, die an das Modell gesendet werden, und die empfangenen Antworten.

- Toolaufrufe: Welche Tools aufgerufen wurden, mit Argumenten und Ausgaben.

Erweitern Sie einen beliebigen Schritt, um vollständige Details anzuzeigen, einschließlich Tokenanzahl und Latenz.

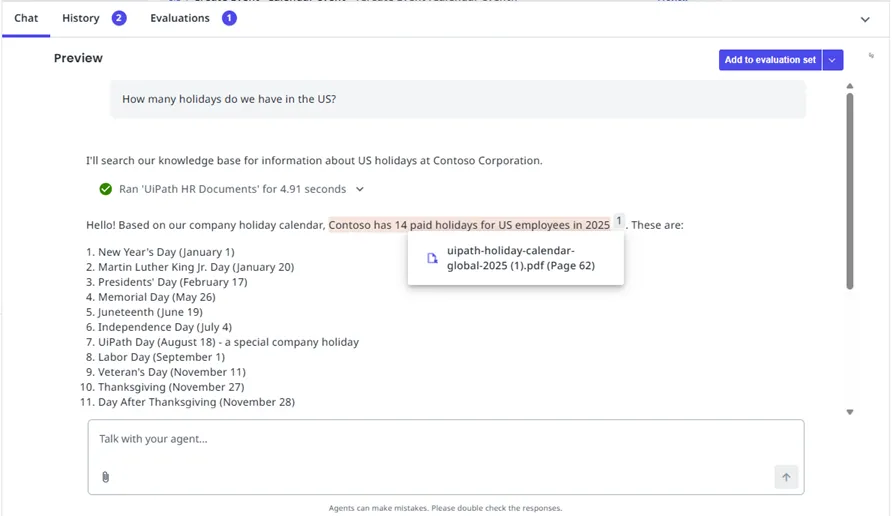

Anzeigen von Zitaten

Wenn Ihr Agent Kontextgrundlage verwendet, werden Zitate in der Antwort angezeigt, die zeigen, welche Dokumente die Antwort informiert haben.

- Suchen Sie in der Antwort des Agenten nach Zitatmarkern (in der Regel nummerierte Referenzen).

- Wählen Sie ein Zitat aus, um die Quelle und den relevanten Auszug anzuzeigen.

- Stellen Sie sicher, dass Zitate die Antwort des Agenten genau unterstützen.

Hinzufügen von Konversationen zu Auswertungssätzen

Speichern Sie nach einer erfolgreichen Testinteraktion für automatisierte Tests:

- Wählen Sie auf der Registerkarte „Chat“ die Option Zu Auswertungssatz hinzufügen aus.

- Wählen Sie einen vorhandenen Auswertungssatz aus oder erstellen Sie einen neuen.

Die Konversation wird gespeichert mit:

- Konversationsverlauf: Alle vorherigen Runden im Dialog.

- Aktuelle Benutzernachricht: Die letzte Eingabe des Benutzers.

- Erwartete Agent-Antwort: Die tatsächliche Antwort des Agents (die Sie bearbeiten können).

Auswertungssätze

Auswertungssätze sind Sammlungen von Testfällen, die das Verhalten Ihres Agenten validieren.Sie unterstützen sowohl Einzel- als auch mehrstufige Testszenarien.

Ausführliche Anleitung zur Auswertung finden Sie unter Agenten-Auswertungen.

Einzelturn-Auswertungen

Einzelturn-Auswertungen testen isolierte Frage-und-Antwort-Paare ohne Konversationsverlauf.Es handelt sich um Auswertungstests, bei denen Sie den ersten Eingabeaufforderung in einer Konversation testen.

Verwenden Sie Einzelrundenbewertungen für:

- Testen der spezifischen Wissensabfrage.

- Validierung der Toolauswahl für verschiedene Absichten.

- Überprüfen des Antwortformats und des Tonfalls.

Beispiel:

| Benutzernachricht | Erwartetes Verhalten |

|---|---|

| „Wie viele Feiertage haben wir in den USA?“ | Gibt die korrekte Anzahl zurück und zitiert das Richtliniendokument. |

| „Planen Sie ein Meeting mit John für morgen um 14 Uhr.“ | Ruft das Kalendertool mit den richtigen Parametern auf. |

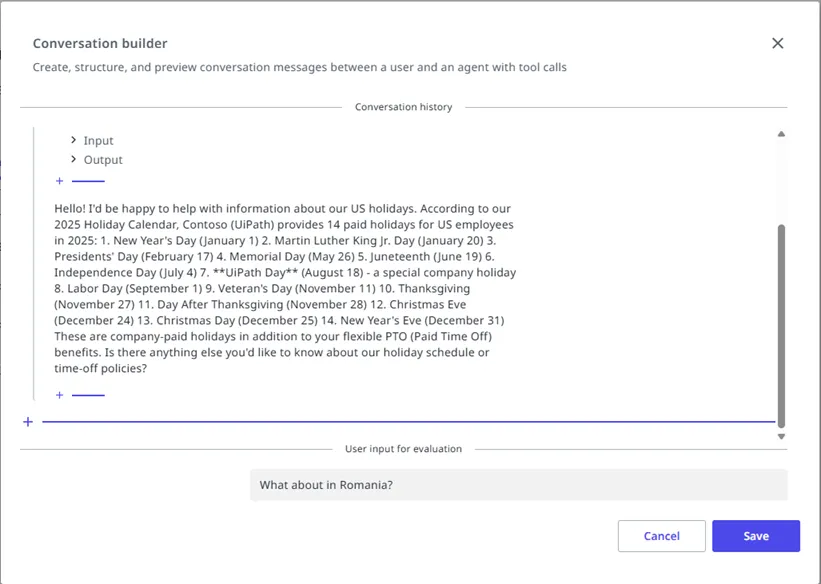

Mehrstufige Auswertungen

Mehrstufige Auswertungen testen, wie der Agent Konversationskontext und Anschlussfragen behandelt. Es handelt sich um Auswertungstests, bei denen der getestete Prompt einer vorherigen Konversation folgt.

Verwenden Sie mehrstufige Auswertungen für:

- Testen der Kontextaufbewahrung über Runden hinweg.

- Validierung der Pronomenauflösung („es“, „das“, „dasselbe“).

- Überprüfen des Konversationsflusses und der Kohärenz.

Beispiel:

| Runde | Meldung | Erwartetes Verhalten |

|---|---|---|

| 1 | „Was ist die Urlaubsrichtlinie (PTO)?“ | Gibt eine PTO-Richtlinienzusammenfassung zurück |

| 2 | „Wie fordere ich eine Auszeit anfordern?“ | Verweise im PTO-Kontext, erklärt den Prozess zum Anfordern. |

| 3 | „Kann ich das über E-Mail tun?“ | Versteht, dass sich „das“ auf das Anfordern von Freizeit bezieht. |

Erstellen von Auswertungstests

Aus Debug-Chat

- Führen Sie eine Konversation im Debug-Chat aus.

- Wählen Sie im Chat-Bereich die Option Zu Auswertungssatz hinzufügen aus.

- Der Konversationsaustausch wird als Auswertungstest in Ihrem ausgewiesenen Auswertungssatz hinzugefügt.

Verwenden des Conversation Builders

Mit dem Conversation Builder können Sie mehrstufige Testfälle erstellen oder bearbeiten:

- Wählen Sie Auswertungssätze für Ihren Agent in Studio Web aus.

- Wählen Sie einen Auswertungssatz aus oder erstellen Sie einen neuen. Wenn diese Optionen deaktiviert sind, stellen Sie sicher, dass Sie nicht im Debugmodus sind.

- Wählen Sie Hinzufügen aus, um einen vorhandenen Test festzulegen oder zu bearbeiten.

- Verwenden Sie den Conversation Builder, um:

- Fügen Sie Gesprächsverlaufsschritte hinzu.

- Definieren Sie die aktuelle Benutzernachricht.

- Verwenden Sie die Ausgabe, um die Assertion zu definieren.

- Geben Sie die erwartete Agent-Antwort für deterministische und LLM-als-Richter-basierte Auswerter an.

- Geben Sie die „Verhaltens- und Ausgabenotizen“ für trajektorienbasierte Auswerter an.

Toolsimulationen

Mit Simulationen können Sie das Agent-Verhalten testen, ohne echte Tool-Endpunkte auszuführen. Für jeden Auswertungstest können Sie angeben, ob Tools ihre Ausführung tatsächlich durchführen oder simulieren sollen.

Simulationen verbessern Agenten-Auswertungen, indem sie Folgendes aktivieren:

- Sichere Tests: Vermeiden Sie unbeabsichtigte Nebenwirkungen durch Aufrufe echter APIs oder Dienste.

- Schnellere Ausführung: Überspringen Sie Netzwerklatenz und Verzögerungen durch externe Dienste.

- Kostengünstige Ausführungen: Reduzieren Sie API-Kosten während iterativer Tests.

- Reproduzierbarkeit: Erhalten Sie konsistente Ergebnisse, indem Sie die Toolausgaben steuern.

Sie können das Simulationsverhalten für jeden Auswertungstest konfigurieren:

- Öffnen Sie einen Auswertungssatz.

- Wählen Sie einen Testfall zum Bearbeiten aus.

- Geben Sie in der Testkonfiguration an, welche Tools die Ausführung simulieren sollen.

- Definieren Sie die erwartete simulierte Ausgabe für jedes Tool.

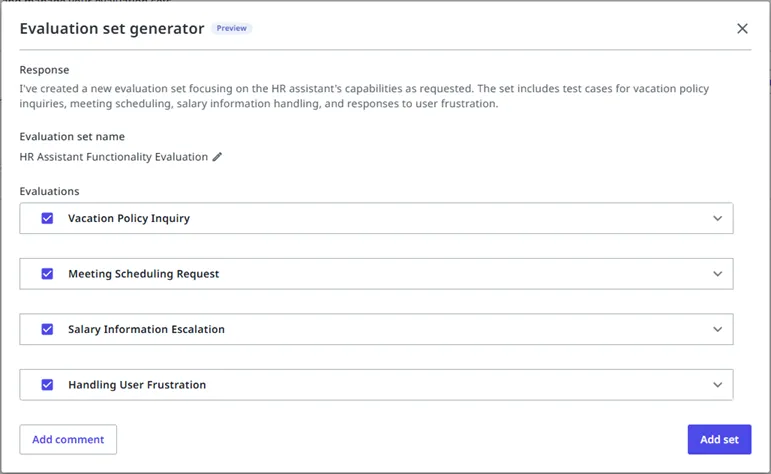

Generieren von Tests mit natürlicher Sprache

Verwenden Sie Autopilot, um Auswertungstests aus Beschreibungen zu generieren:

- Wählen Sie auf dem Bildschirm „Auswertungssätze“ die Option „Erstellen“ und „Neuen Auswertungssatz generieren“ aus.

- Beschreiben Sie die Szenarien, die Sie in natürlicher Sprache testen möchten.

- Überprüfen und optimieren Sie die generierten Testfälle.

Beispielprompt:

Generate test cases for an HR assistant that:

- Answers questions about vacation policy

- Handles requests to schedule meetings

- Escalates when asked about salary information

- Responds appropriately when the user is frustrated

Generate test cases for an HR assistant that:

- Answers questions about vacation policy

- Handles requests to schedule meetings

- Escalates when asked about salary information

- Responds appropriately when the user is frustrated

Von Autopilot generierte Auswertungstests verwenden automatisch trajektorienbasierte Auswertungen.

Ausführen von Auswertungen

Ausführen eines einzelnen Tests

- Wählen Sie einen Testfall aus Ihrem Evaluationssatz aus.

- Wählen Sie Ausgewählte auswerten aus.

- Überprüfen Sie die Ergebnisse und vergleichen Sie die tatsächliche Ausgabe mit der erwarteten Ausgabe.

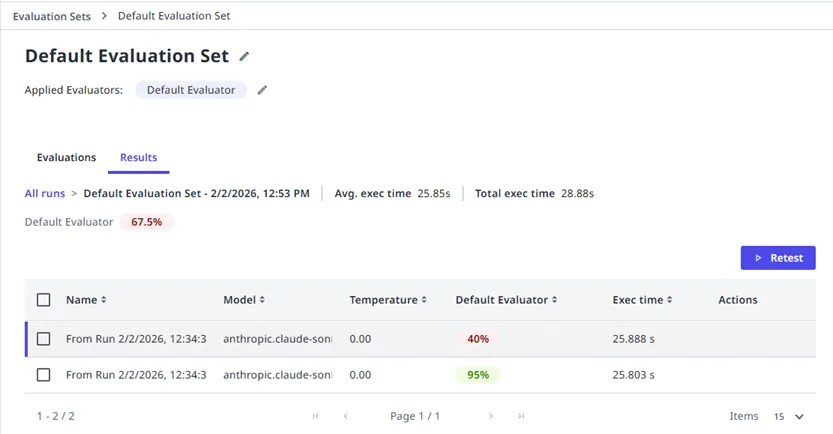

Ausführen von Batch-Auswertungen

- Gehen Sie zu Auswertungssätzen.

- Wählen Sie für den gewünschten Auswertungssatz die Option Ausführen aus, um alle Tests auszuführen.

- Überprüfen Sie die Ergebnisse mit Bestehen-/Nichtbestehensraten.

Testen mit verschiedenen Modellen

Führen Sie denselben Auswertungssatz mit verschiedenen Modellen aus, um die Leistung zu vergleichen:

- Wählen Sie im Auswertungssatz die Option Auswertungseinstellungen aus, um ein zusätzliches Zielmodell hinzuzufügen.

- Führen Sie die Auswertung aus.

- Vergleichen Sie Ergebnisse über Modelle hinweg, um die beste Lösung für Ihren Anwendungsfall zu identifizieren.

Dies hilft Ihnen zu verstehen:

- Welche Modelle für Ihre spezifischen Szenarien die beste Leistung bieten.

- Kompromisse zwischen Antwortqualität und Latenz.

- Kostenauswirkungen verschiedener Modellauswahlen.

Auswertungsmetriken

Auswertungen bewerten mehrere Dimensionen des Agent-Verhaltens:

| Metrik | Beschreibung |

|---|---|

| Antwortgenauigkeit | Enthält die Antwort korrekte Informationen? |

| Toolauswahl | Hat der Agent das entsprechende Tool ausgewählt? |

| Zitatqualität | Sind Zitate relevant und genau? |

| Ton und Format | Entspricht die Antwort dem erwarteten Stil? |

| Kontextaufbewahrung | Pflegt der Agent den Kontext über Runden hinweg? |

Bewährte Methoden zur Auswertung

Testen Sie sowohl erfolgreiche als auch unerwünschte Pfade.

Testen Sie nicht nur ideale Szenarien. Fügen Sie Folgendes ein:

- Mehrdeutige Fragen

- Anfragen außerhalb des Umfangs

- Randfälle und Error-Bedingungen

- Mehrsprachige Eingaben (wenn unterstützt)

Repräsentative Testsuiten erstellen

Erstellen Sie Auswertungssätze, die echte Nutzungsmuster widerspiegeln:

- Analysieren Sie häufige Benutzerabfragen aus der Produktion.

- Variationen der gleichen Frage einschließen

- Testen Sie verschiedene Benutzerpersönlichkeiten und Kommunikationsstile

Iterieren basierend auf Ergebnissen

Verwenden Sie Auswertungsfehler, um Ihren Agent zu verbessern:

- Identifizieren Sie Muster in fehlgeschlagenen Tests.

- Aktualisieren Sie System-Prompts oder Toolkonfigurationen.

- Führen Sie Auswertungen erneut aus, um Verbesserungen zu überprüfen.

- Fügen Sie neue Tests für erkannte Randfälle hinzu.

Nächste Schritte

- Bereitstellung: Veröffentlichen Sie Ihren getesteten Agenten

- Beobachtbarkeit: Überwachen Sie die Produktionsleistung

- Agent-Auswertungen: Detaillierte Dokumentation des Auswertungsframeworks

- Debug-Chat

- Starten einer Debug-Sitzung

- Anzeigen von Ausführungsspuren

- Anzeigen von Zitaten

- Hinzufügen von Konversationen zu Auswertungssätzen

- Auswertungssätze

- Einzelturn-Auswertungen

- Mehrstufige Auswertungen

- Erstellen von Auswertungstests

- Ausführen von Auswertungen

- Ausführen eines einzelnen Tests

- Ausführen von Batch-Auswertungen

- Testen mit verschiedenen Modellen

- Auswertungsmetriken

- Bewährte Methoden zur Auswertung

- Testen Sie sowohl erfolgreiche als auch unerwünschte Pfade.

- Repräsentative Testsuiten erstellen

- Iterieren basierend auf Ergebnissen

- Nächste Schritte