- Primeros pasos

- Agentes de UiPath en Studio Web

- Acerca de los agentes de UiPath

- Licencia

- Ejecución de agentes

- Agentes y flujos de trabajo

- Mejores prácticas para construir agentes.

- Elegir el mejor modelo para tu agente

- Mejores prácticas para publicar e implementar agentes

- Mejores prácticas para el diseño de contexto.

- Prácticas recomendadas para DeepRAG y Transformación por Lote: JIT frente a estrategias basadas en índice.

- Solicitudes

- Trabajar con archivos

- Contextos

- Escalaciones y memoria del agente

- Evaluaciones

- Seguimientos de agente

- Puntuación del agente

- Gestión de agentes de UiPath

- Agentes de UiPath codificados

Guía del usuario de Agents

Las evaluaciones ayudan a garantizar que tu agente de conversación se comporta de forma fiable en rutas de diálogo variadas. Esta página explica cómo probar tu agente utilizando el chat de depuración, creando conjuntos de evaluación y ejecutando pruebas automatizadas.

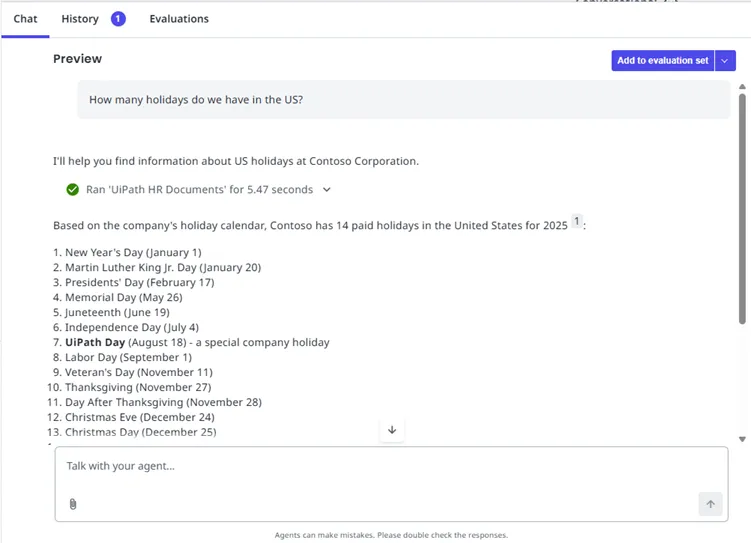

Chat de depuración

Chat de depuración proporciona un entorno de prueba en tiempo real donde puedes interactuar con tu agente e inspeccionar su comportamiento.

Iniciar una sesión de depuración

- En Studio Web, abre tu agente conversacional.

- Selecciona Depurar para abrir la interfaz de chat.

- Envía mensajes para probar las respuestas de tu agente.

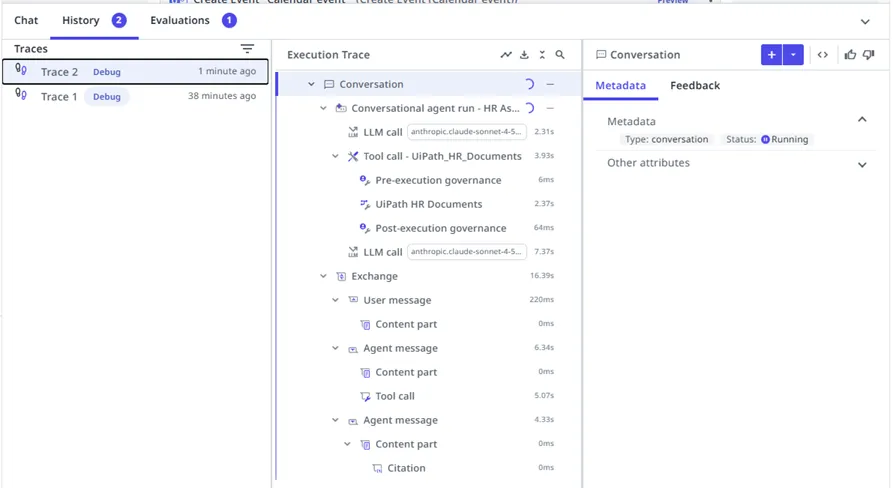

Ver seguimientos de ejecución

El panel de historial muestra detalles en tiempo real de la ejecución del agente:

- Llamadas de LLM: las solicitudes enviadas al modelo y las respuestas recibidas.

- Llamadas de herramientas: qué herramientas se invocaron, con argumentos y salidas.

Expande cualquier paso para ver los detalles completos, incluidos los recuentos de tokens y la latencia.

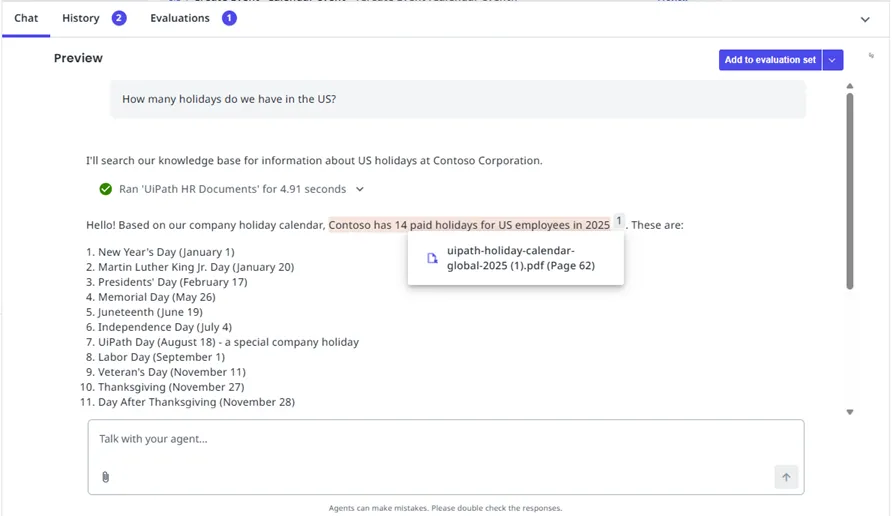

Ver citas

Cuando tu agente utiliza la contextualización, aparecen citas en la respuesta que muestran qué documentos informaron la respuesta.

- Busca marcadores de cita en la respuesta del agente (normalmente referencias numeradas).

- Selecciona una cita para ver el documento de origen y el extracto relevante.

- Verifica que las citas apoyen con precisión la respuesta del agente.

Añadir conversaciones a los conjuntos de evaluación

Después de una interacción de prueba correcta, guárdala para las pruebas automatizadas:

- En la pestaña Chat, selecciona Añadir al conjunto de evaluación.

- Elige un conjunto de evaluación existente o crea uno nuevo.

La conversación se guarda con:

- Historial de conversación: todas las intervenciones anteriores en el diálogo.

- Mensaje de usuario actual: la última entrada del usuario.

- Respuesta esperada del agente: la respuesta real del agente (que puedes editar).

Conjuntos de evaluación

Los conjuntos de evaluación son colecciones de casos de prueba que validan el comportamiento de tu agente. Admiten tanto escenarios de prueba de un solo turno como de varios turnos.

Para obtener una guía de evaluación detallada, consulta Evaluaciones de agente.

Evaluaciones de un solo turno

Las evaluaciones de un solo turno prueban los pares de pregunta y respuesta aislados sin historial de conversación. Son pruebas de evaluación en las que pruebas la primera solicitud de una conversación.

Usa las evaluaciones de un solo turno para:

- Probar la recuperación de conocimiento específico.

- Validar la selección de herramientas para diferentes intenciones.

- Comprobar el formato y el tono de respuesta.

Ejemplo:

| Mensaje de usuario | Comportamiento esperado |

|---|---|

| "¿Cuántos días festivos tenemos en los EE. UU.?" | Devuelve el recuento correcto, cita el documento de política |

| "Programa una reunión con John para mañana a las 14:00" | Llama a la herramienta de calendario con los parámetros correctos |

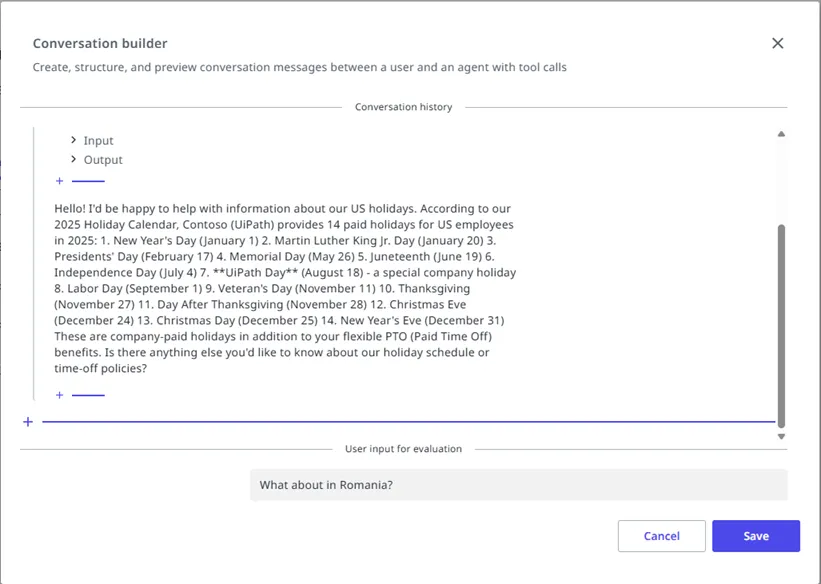

Evaluaciones de varios turnos

Las evaluaciones de varios turnos prueban cómo el agente maneja el contexto de conversación y las preguntas de seguimiento. Son pruebas de evaluación en las que la solicitud probada sigue la conversación anterior.

Usa las evaluaciones de varios turnos para:

- Probar la retención de contexto en todos los turnos.

- Validar la resolución de pronombres ("it", "that", "the same").

- Comprobar el flujo de conversación y la coherencia.

Ejemplo:

| Turno | Mensaje | Comportamiento esperado |

|---|---|---|

| 1 | "¿Cuál es la política de PTO?" | Devuelve el resumen de la política de PTO |

| 2 | "¿Cómo puedo solicitar días libres?" | Hace referencia al contexto de PTO, explica el proceso de solicitud |

| 3 | "¿Puedo hacer eso a través de correo electrónico?" | Entiende que "eso" se refiere a solicitar días libres |

Crear pruebas de evaluación

Desde el chat de depuración

- Ejecuta una conversación en el chat de depuración.

- Seleccionar Añadir a conjunto de evaluación en el panel Chat.

- El intercambio de conversación se añadirá como prueba de evaluación en tu conjunto de evaluación designado.

Usando el Creador de conversación

El Creador de conversación te permite crear o editar casos de prueba de varios turnos:

- Selecciona Conjuntos de evaluación para tu agente en Studio Web.

- Selecciona un conjunto de evaluación o crea uno nuevo. Si estas opciones están deshabilitadas, asegúrate de no estar en modo depuración.

- Seleccionar Añadir a conjunto o edita una prueba existente.

- Usa el Creador de conversación para:

- Añadir turnos del historial de conversación.

- Definir el mensaje de usuario actual.

- Usa Configuración de salida para definir la aserción

- Especifica la respuesta esperada del agente para los evaluadores deterministas y basados en LLM-como-juez.

- Especifica las "notas de comportamiento y salida" para los evaluadores basados en trayectoria.

Simulaciones de herramienta

Las simulaciones te permiten probar el comportamiento del agente sin ejecutar puntos finales de herramienta reales. Para cada prueba de evaluación, puedes especificar si las herramientas deben ejecutarse realmente o simular su ejecución.

Las simulaciones mejoran las evaluaciones de agente al permitir:

- Pruebas seguras: evita los efectos secundarios no deseados de llamar a API o servicios reales.

- Ejecución más rápida: omite la latencia de la red y los retrasos del servicio externo.

- Ejecuciones rentables: reduce los costes de API durante las pruebas iterativas.

- Reproducibilidad: obtén resultados coherentes controlando las salidas de la herramienta.

Puedes configurar el comportamiento de simulación para cada prueba de evaluación:

- Abre un conjunto de evaluación.

- Selecciona un caso de prueba para editar.

- En la configuración de prueba, especifica qué herramientas deben simular la ejecución.

- Define la salida simulada esperada para cada herramienta.

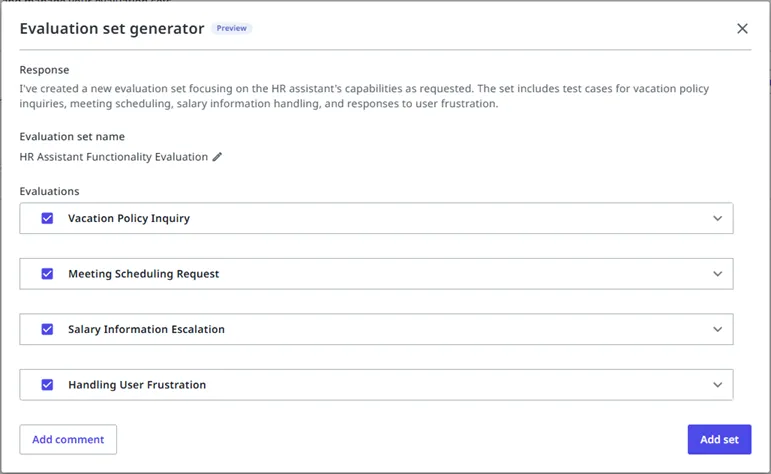

Generar pruebas con lenguaje natural

Usa Autopilot para generar pruebas de evaluación a partir de las descripciones:

- En la pantalla Conjuntos de evaluación, selecciona Crear y luego Generar nuevo conjunto de evaluación.

- Describe los escenarios que quieres probar en lenguaje natural.

- Revisa y refina los casos de prueba generados.

Solicitud de ejemplo:

Generate test cases for an HR assistant that:

- Answers questions about vacation policy

- Handles requests to schedule meetings

- Escalates when asked about salary information

- Responds appropriately when the user is frustrated

Generate test cases for an HR assistant that:

- Answers questions about vacation policy

- Handles requests to schedule meetings

- Escalates when asked about salary information

- Responds appropriately when the user is frustrated

Las pruebas de evaluación generadas por Autopilot utilizan automáticamente evaluaciones basadas en la trayectoria.

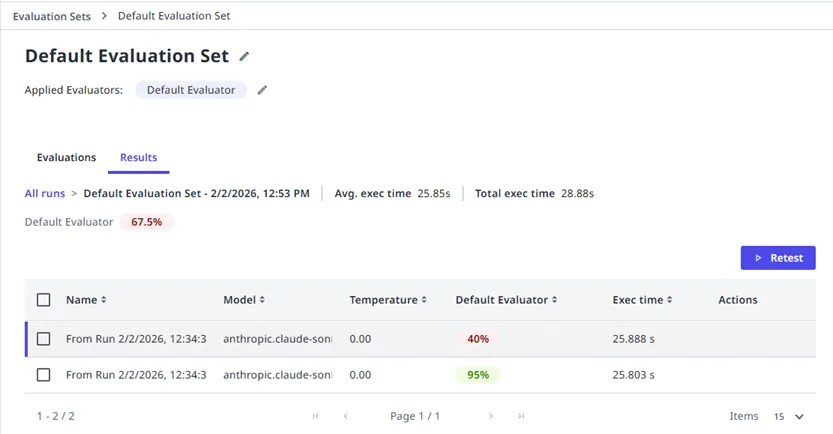

Ejecutar evaluaciones

Ejecutar una sola prueba

- Selecciona un caso de prueba de tu conjunto de evaluación.

- Selecciona Evaluar seleccionado.

- Revisa los resultados, comparando la salida real con la salida esperada.

Ejecutar evaluaciones en lote

- Ve a Conjuntos de evaluación.

- Selecciona Ejecutar en el conjunto de evaluación deseado para ejecutar todas las pruebas.

- Revisa los resultados que muestran las tasas de aprobación/error.

Pruebas con diferentes modelos

Ejecuta el mismo conjunto de evaluación en diferentes modelos para comparar el rendimiento:

- En el conjunto de evaluación, seleccionar Configuración de evaluación para añadir un modelo de destino adicional.

- Ejecuta la evaluación.

- Compara los resultados de todos los modelos para identificar el mejor ajuste para tu caso de uso.

Esto te ayuda a entender:

- Qué modelos funcionan mejor para tus escenarios específicos.

- Compensaciones entre la calidad de respuesta y la latencia.

- Implicaciones de coste de las diferentes opciones de modelo.

Métricas de evaluación

Las evaluaciones evalúan varias dimensiones del comportamiento del agente:

| Métrica | Descripción |

|---|---|

| Precisión de la respuesta | ¿Contiene la respuesta información correcta? |

| Selección de herramienta | ¿Eligió el agente la herramienta adecuada? |

| Calidad de la cita | ¿Las citas son relevantes y precisas? |

| Tono y formato | ¿Coincide la respuesta con el estilo esperado? |

| Retención de contexto | ¿Mantiene el agente el contexto en todos los turnos? |

Prácticas recomendadas de evaluación

Prueba tanto con las rutas felices como con las no felices

No te limites a probar escenarios ideales. Incluye:

- Preguntas ambiguas

- Solicitudes fuera de ámbito

- Casos límite y condiciones de error

- Entradas multilenguaje (si se admite)

Crea suites de prueba representativas

Construye conjuntos de evaluación que reflejen los patrones de uso reales:

- Analiza las consultas de usuario comunes de la producción

- Incluye variaciones de la misma pregunta

- Prueba diferentes perfiles de usuario y estilos de comunicación

Itera en función de los resultados

Usa los fallos de evaluación para mejorar tu agente:

- Identifica patrones en las pruebas fallidas.

- Actualiza las solicitudes del sistema o las configuraciones de las herramientas.

- Vuelve a ejecutar las evaluaciones para verificar las mejoras.

- Añade nuevas pruebas para los casos límite descubiertos.

Próximos pasos

- Implementación: publica tu agente probado

- Observabilidad: monitoriza el rendimiento de producción

- Evaluaciones de agentes: documentación detallada del marco de evaluación

- Chat de depuración

- Iniciar una sesión de depuración

- Ver seguimientos de ejecución

- Ver citas

- Añadir conversaciones a los conjuntos de evaluación

- Conjuntos de evaluación

- Evaluaciones de un solo turno

- Evaluaciones de varios turnos

- Crear pruebas de evaluación

- Ejecutar evaluaciones

- Ejecutar una sola prueba

- Ejecutar evaluaciones en lote

- Pruebas con diferentes modelos

- Métricas de evaluación

- Prácticas recomendadas de evaluación

- Prueba tanto con las rutas felices como con las no felices

- Crea suites de prueba representativas

- Itera en función de los resultados

- Próximos pasos