- Introdução

- Gerenciamento do projeto

- Documentos

- Trabalhando com análise de impacto de alterações

- Criar casos de teste

- Atribuição de casos de teste a requisitos

- Casos de teste de clonagem

- Exportação de casos de teste

- Vinculação de casos de teste no Studio ao Test Manager

- Delete test cases

- Casos de teste manuais

- Importação de casos de teste manuais

- Documentar casos de teste com o Task Capture

- Parâmetros

- Habilitação de governança no nível do projeto

- Desabilitação da governança no nível do projeto

- Habilitação de governança no nível do caso de teste

- Como desabilitar a governança no nível do caso de teste

- Gerenciamento de aprovadores para casos de teste controlados

- Gerenciamento de casos de teste governados no estado Em andamento

- Gerenciamento de casos de teste governados no estado Em Revisão

- Gerenciamento de objetos governados no estado Assinado

- Gerenciamento de comentários para casos de teste governados

- Aplicação de filtros e visualizações

- Importando conjuntos de testes do Orchestrator

- Creating test sets

- Adição de casos de teste a um conjunto de testes

- Atribuição de usuários padrão na execução do conjunto de testes

- Habilitando a cobertura de atividade

- Habilitação do Healing Agent

- Configuração de conjuntos de testes para pastas e robôs de execução específicos

- Substituindo parâmetros

- Clonagem de conjuntos de teste

- Exportação de conjuntos de testes

- Aplicação de filtros e visualizações

- Perguntas frequentes - Paridade de funcionalidades - Test Manager versus Orchestrator

- Execução de testes manuais

- Execução de testes automatizados

- Execução de casos de teste sem um conjunto de testes

- Execução de testes mistos

- Criação de execuções pendentes

- Aplicação de uma ordem de execução

- Reexecutando execuções de teste

- Agendamento de execuções

- Solução de problemas de execuções automatizadas

- Testes de acessibilidade para o Test Cloud

- Pesquisa com o Autopilot

- Operações e utilitários do projeto

- Importar projeto

- Exportar projeto

- Exportar Dados

- Especificação do formato de arquivo TMH

- Operações em massa

- Gerar relatórios com o Insights

- Relatórios do painel do Test Manager

- Uso de ferramentas externas de relatório

- Migração de artefatos do Test Manager para outras opções de entrega

- Política de retenção de dados de teste

- Configurações Test Manager

- Integração da ferramentas ALM

- Integração do API

- Solução de problemas

Guia do usuário do Test Manager

Pré-requisitos

A disponibilidade de funcionalidades depende da plataforma de cloud que você usa. Para obter detalhes, consulte a página de disponibilidade da funcionalidade Test Manager.

Para habilitar a geração de relatórios com o Insights, siga estas etapas:

- Habilite o serviço Insights no mesmo tenant que sua instância do Test Manager. Você precisa de uma função de Administrador da Organização do Automation Cloud para habilitar um serviço.

- No Test Manager, ative a configuração Habilitar relatórios com o nível de tenant do Insights . Você precisa de uma função de tenant Administrador do Test Manager para habilitar a integração com o Insights. Para obter mais informações sobre como ativar a configuração, acesse Configurações ao nível do tenant.

Visão geral

Depois de habilitar a integração do Insights em seu tenant do Test Manager, você poderá acessar análises para todos os seus projetos de teste dentro desse tenant. O Insights recupera dados do Test Manager, com base em um modelo de dados específico, e os apresenta por meio do painel predefinido Relatório de Execução do Test Manager . Este painel fornece uma visão geral de todas as suas execuções de teste dentro de seu tenant.

Figura 1. Painel de Relatório de execução do Test Manager

Quando você habilita a geração de relatórios com o Insights, os dados de todos os projetos do Test Manager são carregados para o Insights. Portanto, todos os usuários com acesso ao Insights poderão gerar relatórios sobre esses projetos, independentemente das permissões que tenham no Test Manager.

Modelo de dados

O Insights usa logs de casos de teste do Test Manager para gerar os painéis personalizáveis. Para obter mais detalhes sobre o modelo de dados usado pelo Insights para gerar os painéis, consulte a seção Modelo de dados do Test Manager .

No modelo de dados do Test Manager, os logs de casos de teste contêm dois tipos de resultados: técnicos e funcionais. Normalmente, esses resultados são os mesmos, a menos que um erro técnico apareça durante a execução. Os erros técnicos podem incluir interrupções de infraestrutura, erros de automação ou outros gatilhos não funcionais. Em qualquer um desses cenários, os resultados técnicos rotularão o teste como com falha. Os resultados funcionais devem refletir apenas o resultado das verificações de negócios. Portanto, indicam sem resultado em caso de erros devido à falta de um resultado confiável.

Criação de painéis do Insights com base em campos personalizados

Você pode criar painéis do Insights para Requisitos e Conjuntos de testes com base nos campos personalizados associados a esses objetos de dados.

Você pode trabalhar com no máximo 5 seletores de campos personalizados e 5 dimensões.

- Faça logon na sua plataforma e navegue até o Insights.

- Acesse Painéis e adicione um painel.

- Abra o painel e selecione Editar painel.

- Passe o cursor do mouse na barra de ferramentas e selecione Adicionar.

Figura 2. Adicionar painel do Insights

-

Selecione Visualização.

-

Em Test Manager, selecione o objeto de dados para o qual você deseja criar um painel. Por exemplo, vamos selecionar Requisitos.

-

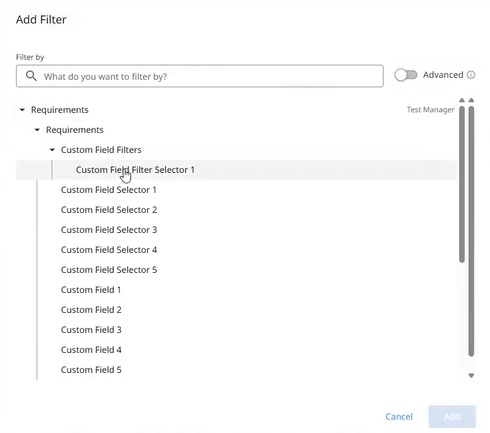

Expanda a categoria do objeto de dados. Para nosso exemplo, expanda Requisitos. Observe que você pode ter no máximo cinco seletores de campos personalizados (listados como Seletor de campos personalizados 1 e assim por diante, em Campos somente filtrados) e 5 dimensões (listadas como Campo personalizado 1 e assim por diante, em Dimensões). Há uma correspondência 1:1 entre os 5 seletores de campos personalizados e as 5 dimensões de campos personalizados. Por exemplo, o Seletor de campo personalizado 1 corresponde ao Campo personalizado 1.

-

Em Campos somente filtrar, selecione um ou mais seletores de campo personalizados.

Figura 3. Seleção de campo personalizado

- Expanda o menu suspenso para ver todos os campos personalizados disponíveis no tenant para seu objeto de dados. O exemplo abaixo mostra os campos personalizados disponíveis no tenant de amostra, para requisitos.

Figura 4. Valores de campos personalizados

-

Selecione os valores de campo personalizados para seus seletores de campos personalizados.

-

Em Dimensões, selecione os campos personalizados. Por exemplo, selecione Campo personalizado 1, Campo personalizado 2 e Campo personalizado 3.

-

Em Filtros de campos personalizados, selecione os valores que você precisa. Por exemplo, selecione Nome e Nome do projeto.

-

Em Medidas, selecione os valores de que você precisa. Para esse exemplo, selecione Contagem total de casos de teste.

-

Os valores que você selecionou são exibidos no lado direito, no editor de espaço de trabalho.

Figura 5. Medidas

15. No lado superior direito do espaço de trabalho, selecione Executar.

Figura 6. Executar painel

16. Aguarde o carregamento dos dados. Os dados podem ser visualizados em vários formatos: tabela, gráficos ou tabelas.

-

(Opcional) Classifique seus dados por coluna. Por exemplo, classifique seus dados por prioridade.

-

No lado superior direito do editor de espaço de trabalho, selecione Salvar.

-

Selecione o ícone de lápis ou clique dentro do nome da tabela para dar um nome oficial a seu painel. Em nosso exemplo, nomeamos o painel "Campo personalizado para requisito".

-

Redimensione a tabela arrastando suas bordas.

-

No menu da barra de ferramentas, adicione um filtro para o seu painel.

-

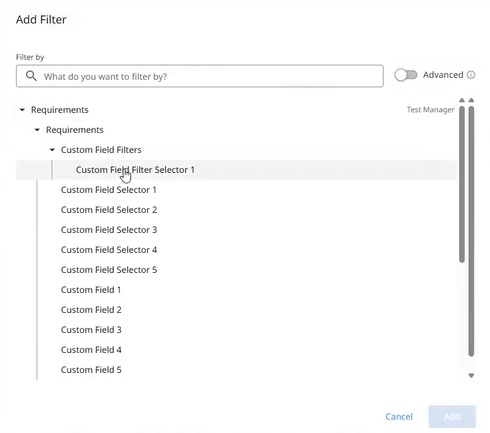

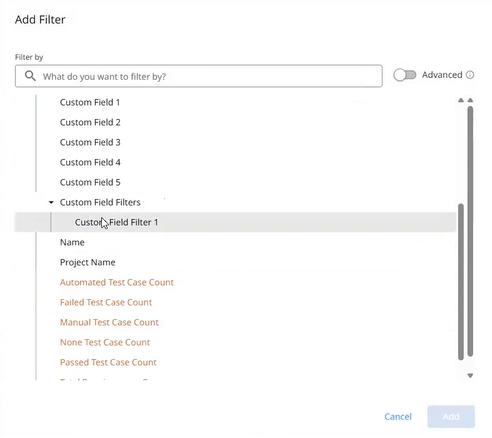

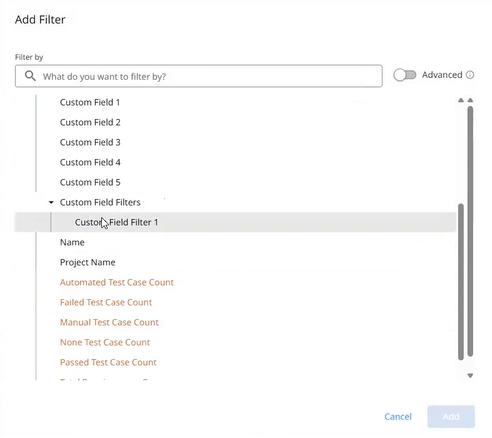

Selecione Filtros > Adicionar filtro.

-

Adicione filtros para seu objeto de dados, em nosso caso Requisitos. Expanda o objeto de dados (Requisitos), expanda Filtros de campos personalizados e escolha um seletor (por exemplo, Seletor de filtros de campos personalizados 1).

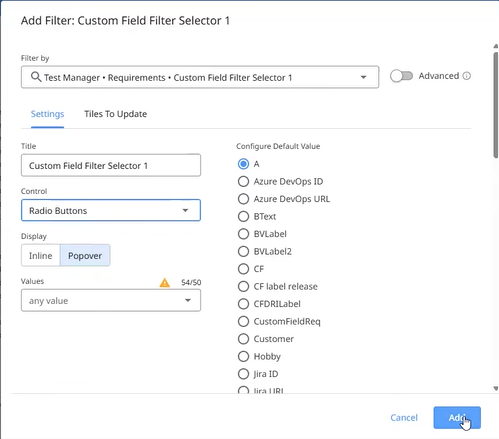

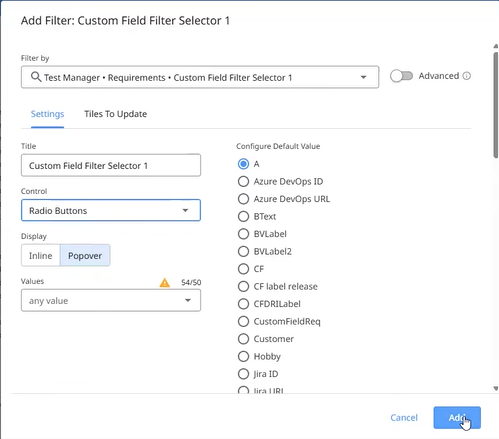

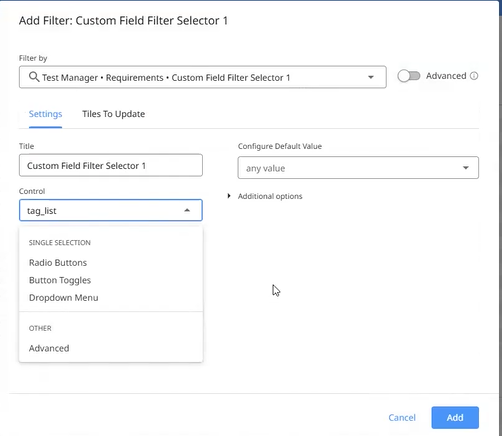

Figura 7. Filtros

24. Na caixa de diálogo Adicionar filtro , continue configurando seu filtro (título, controle, valor padrão) e selecione Adicionar. Para esse exemplo, escolhemos um botão de rádio.

Figura 8. Adicionar filtro

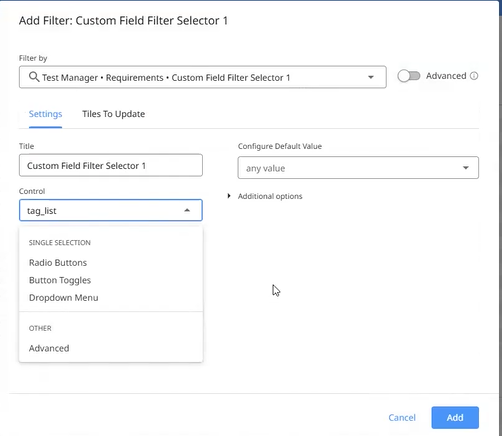

25. Expanda o objeto de dados (Requisitos) novamente e escolha o valor do seletor. Para esse exemplo, selecionamos Filtros de campo personalizado > Filtro de campo personalizado 1.

Figura 9. Filtro de campos personalizados

26. Na caixa de diálogo Adicionar filtro , continue a configuração (título, controle, opções de filtro) e selecione Adicionar. Para nosso exemplo, escolhemos Avançado no campo Controle e é qualquer valor do campo Configurar valor padrão .

Figura 10. Configuração do filtro

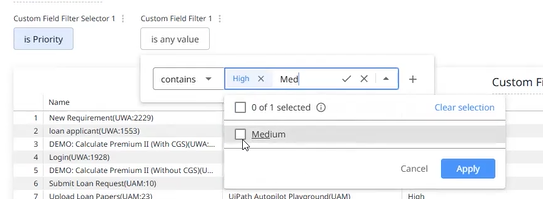

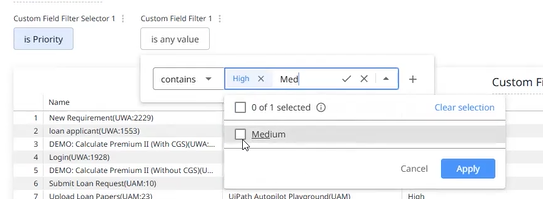

27. Em seu painel, verifique o filtro que você adicionou. Para este exemplo, adicionamos o Seletor de filtro de campo personalizado 1 e o Filtro de campo personalizado 1. Abaixo do primeiro filtro, expanda o menu, selecione um valor (Prioridade) e selecione Aplicar. Abaixo do segundo filtro, expanda o menu é qualquer valor , selecione um operador e um valor (contém Alto ou Médio) e selecione Aplicar.

Figura 11. Filtrar valores

28. Selecione o botão Atualizar no canto superior direito do editor de espaço de trabalho.

Modelo de dados do Test Manager

Terms and concepts

A estrutura do modelo de dados do Test Manager é baseada nos seguintes conceitos:

| Conceito | Description |

|---|---|

| Explorar | O ponto de partida para a exploração. Os dados são exibidos por meio do Explores, que você pode imaginar como uma entidade geral que corresponde aos campos dentro dela. |

| Exibir | Uma exibição representa uma tabela de dados, seja essa tabela nativa do seu banco de dados ou criada usando a funcionalidade de tabela derivada do Looker. Dentro de cada exibição estão as definições de campo, cada uma das quais geralmente corresponde a uma coluna na tabela subjacente ou a um cálculo no Looker. |

| Dimensões | Como parte de uma exibição no Explore, a dimensão é um campo agrupável e pode ser usado para filtrar os resultados da consulta. Pode ser um dos seguintes:

|

| Medida | Como parte de uma exibição no Explore, o parâmetro Measure declara uma nova medida (agregação) e especifica um nome para essa medida. integer , string . |

Dimensões e medidas

A disponibilidade de funcionalidades depende da plataforma de cloud que você usa. Para obter detalhes, consulte a página de disponibilidade da funcionalidade Test Manager.

Os Requisitos, Conjuntos de testes, e as dimensões e medidas de Execuções de teste estão disponíveis no Test Manager apenas quando entregues por meio do Test Cloud.

Logs de casos de teste

As tabelas a seguir descrevem as dimensões e medidas disponíveis para logs de casos de teste.

| Dimensões | Tipo | Description |

|---|---|---|

| Email do Destinatário | String | O endereço de e-mail do usuário ao qual um caso de teste foi atribuído. |

| Nome do Projeto de Automação | String | O nome da automação vinculada ao caso de teste. |

| Data de Conclusão | data | A data em que um caso de teste manual estava agendado para ser executado. |

| Início da execução | data | A data de início da execução do teste. |

| Executado por | String | O nome de usuário ou nome do robô que executou o teste. |

| Fim de Execução | data | A data de término da execução do teste. |

| Tipo de execução | String | O tipo de execução:

|

| Nome da Máquina do Host | String | O nome da máquina. |

| Nome do Projeto | String | O nome do projeto do Test Manager. |

| Prefixo do projeto | String | O prefixo do projeto do Test Manager. |

| Data do relatório | data | A data em que o teste foi executado. É uma data sem horário e também sem fuso horário. |

| Resultado | String | O resultado do caso de teste: Aprovado, Falha ou Nenhum. |

| Nome do Robô | String | O nome do robô que executou o teste. |

| Nome da execução de teste | String | O nome da execução de teste. |

Tabela 2. Medidas de Logs de casos de teste

| Medidas | Tipo | Description |

|---|---|---|

| Contagem Total | Número inteiro | O número total de logs de casos de teste. |

| Contagem aprovada | String | O número de logs de casos de teste aprovados. |

| Contagem não aprovada (técnica) | Número inteiro | Os resultados técnicos indicam os resultados como com falha quando uma exceção ocorre durante a execução. |

| Sem contagem de resultados (técnico) | Número inteiro | Os resultados técnicos indicam que não há resultados quando uma exceção ocorre durante a execução. |

| DurationInSeconds | Número inteiro | Runtime total em segundos. |

Requisitos

As tabelas a seguir descrevem as dimensões e medidas disponíveis para requisitos.

Tabela 3. Dimensões de requisito

| Dimensões | Tipo | Description |

|---|---|---|

| Nome do Projeto | String | Uma combinação do nome do projeto e do prefixo do projeto com o objetivo de torná-lo único e aumentar a legibilidade. |

| Name | String | Uma combinação da chave de requisito e seu nome, com o objetivo de torná-la exclusiva e aumentar a legibilidade. |

Tabela 4. Medidas de requisito

| Medida | Tipo | Description |

|---|---|---|

| Contagem total de casos de teste | Número inteiro | O número de casos de teste atribuídos a um requisito. |

| Contagem de casos de teste automatizados | Número inteiro | O número de casos de teste automatizados atribuídos a um requisito. |

| Contagem de casos de teste manuais | Número inteiro | O número de casos de teste manuais atribuídos a um requisito. |

| Contagem de casos de teste aprovados | Número inteiro | O número de casos de teste atribuídos a um requisito que passaram na execução de teste mais recente. |

| Contagem de casos de teste com falha | Número inteiro | O número de casos de teste atribuídos a um requisito que falharam na execução de teste mais recente. |

| Nenhuma contagem de casos de teste | Número inteiro | O número de casos de teste atribuídos a um requisito sem nenhum resultado na execução de teste mais recente. |

| Contagem total de requisitos | Número inteiro | O número total de requisitos. |

Conjuntos de Testes

As tabelas a seguir descrevem as dimensões e medidas disponíveis para conjuntos de testes.

Para casos de teste atribuídos, a visualização de conjuntos de testes contém informações sobre atribuições de testes estáticas.

Tabela 5. Dimensões do conjunto de testes

| Dimensões | Tipo | Description |

|---|---|---|

| Nome do Projeto | String | Uma combinação do nome do projeto e do prefixo do projeto com o objetivo de torná-lo único e aumentar a legibilidade. |

| Name | String | Uma combinação do nome do projeto e do prefixo do projeto com o objetivo de torná-lo único e aumentar a legibilidade. |

| Nome do Robô | String | O nome do robô que executou o conjunto de testes. |

| Origem | String | A origem do conjunto de testes: Orchestrator ou Test Manager. |

Tabela 6. Medidas do conjunto de testes

| Medida | Tipo | Description |

|---|---|---|

| Contagem total de conjuntos de teste | Número inteiro | O número de conjuntos de testes. |

| Contagem de casos de teste automatizados | String | O número de casos de teste automatizados no conjunto de testes. |

| Contagem de casos de teste manuais | Número inteiro | Número de casos de teste manuais no conjunto de testes. |

Execução de teste

As tabelas a seguir descrevem as dimensões e medidas disponíveis para execuções de teste.

Tabela 7. Dimensões de execuções de teste

| Dimensões | Tipo | Description |

|---|---|---|

| Nome do Projeto | String | Uma combinação de prefixo e nome do projeto para torná-lo exclusivo e aumentar a legibilidade. |

| Name | String | Uma combinação de ID e nome de execução para torná-la exclusiva e aumentar a legibilidade. |

| Nome do Conjunto de Testes | String | Uma combinação de chave e nome do conjunto de testes para torná-lo exclusivo e aumentar a legibilidade. |

| Tipo de execução | String | O tipo de execução: Manual, Automatizado, Nenhum ou Misto. |

| Origem | String | A origem da execução: TestManager, Orchestrator ou Studio. |

Tabela 8. Medidas de execução de teste

| Medida | Tipo |

|---|---|

| Contagem total de execuções de teste | Número inteiro |

| Contagem de tipos de execução manuais | Número inteiro |

| Contagem de tipos de execução automatizados | Número inteiro |

| Contagem de tipos de execução mistos | Número inteiro |

| Duração em segundos da execução do teste | Número inteiro |