- Vue d'ensemble (Overview)

- Construction de modèles

- Validation du modèle

- Vue d'ensemble (Overview)

- Évaluer les performances du modèle

- Collecte de statistiques de validation

- Itération sur la taxonomie

- Déploiement du modèle

- API

- Questions fréquemment posées

Guide de l'utilisateur des documents complexes et non structurés

Vous pouvez évaluer les performances du modèle aux emplacements suivants :

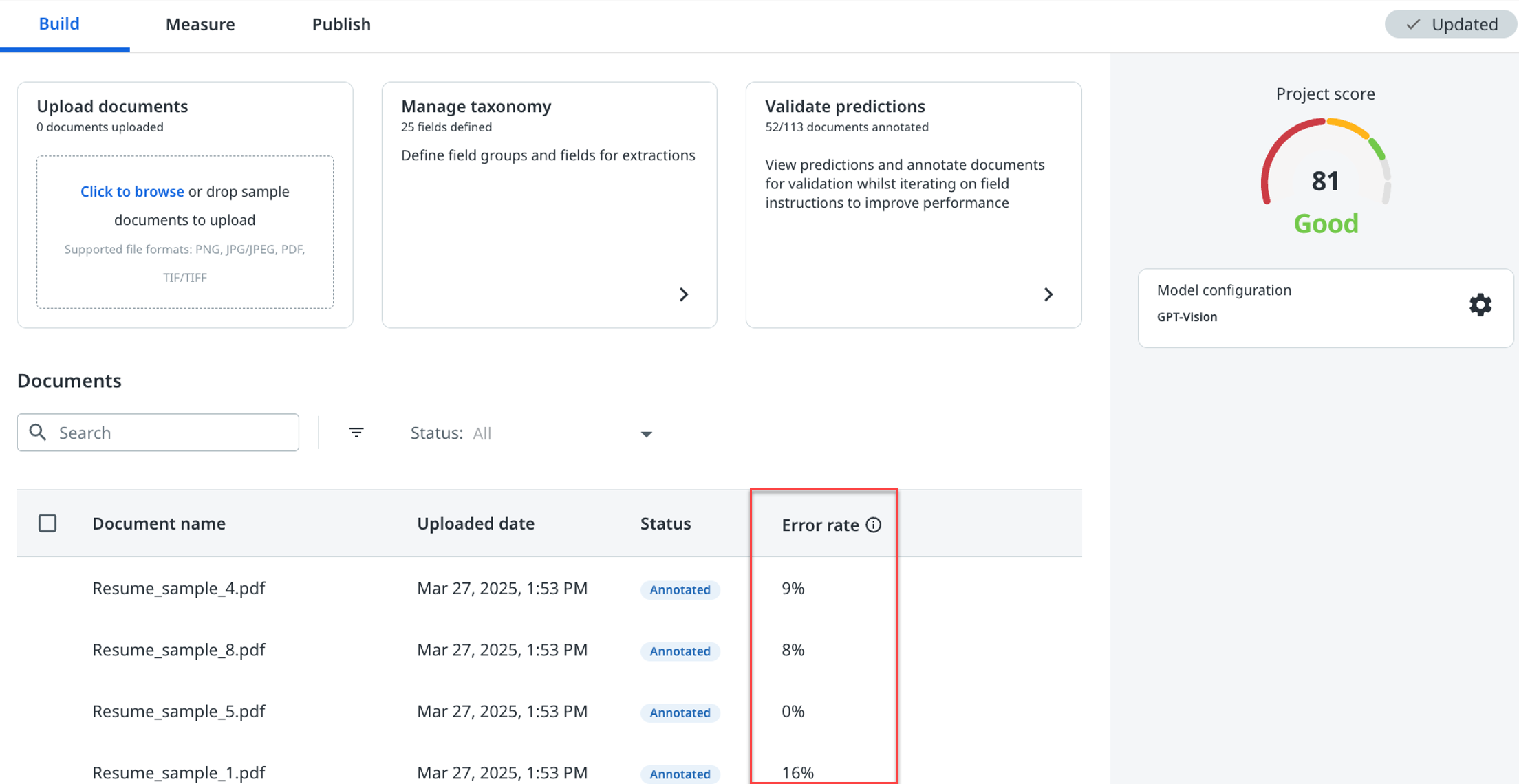

- L’onglet Construire, qui affiche le score global du projet, ainsi que le taux d’erreur de chaque document.

- L’onglet Mesurer, qui affiche les performances au niveau du groupe de champs et du champ.

Évaluation des performances du modèle dans Construire

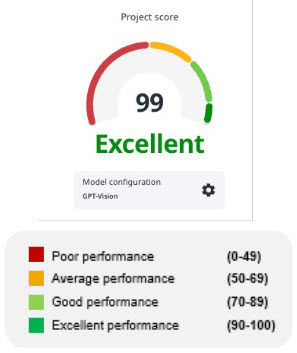

Vous pouvez afficher une note globale sous le Score du projet dans l’onglet Construire.

- Les modèles sains ont un score de projet Bon ou Excellent et ne génèrent aucun avertissement de performance du champ.

- La note du projet est calculée en fonction de la note moyenne F1 de tous les champs.

En outre, vous pouvez consulter le taux d’erreur de chaque document dans la colonne Taux d’erreur de la section Documents dans Construire.

Les taux d’erreur sont uniquement disponibles pour les documents annotés et indiquent le nombre d’erreurs que le modèle a fait sur chaque document, c’est-à-dire la différence entre les prédictions du modèle et les annotations de l’utilisateur.

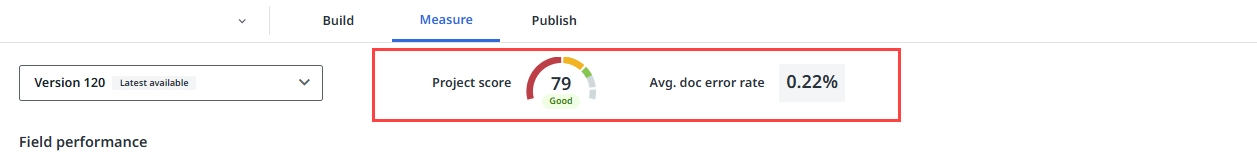

Évaluation des performances du modèle dans Mesurer

Les mises à jour de la page Measure sont disponibles en aperçu public.

La page Measure vous aide à évaluer les performances d’un modèle sur des documents annotés avant de les publier. La page inclut :

- Une table de performances de champ qui fait apparaître les principales métriques de performances par champ et groupe de champs.

- Prise en charge de la comparaison des différences de performances entre les versions de modèle, mise en surbrillance des améliorations ou des régressions.

- Visibilité dans la distribution des types d'erreur pour chaque champ de taxonomie.

- Capacités d’exportation de données pour une analyse hors ligne personnalisée.

Les sections suivantes décrivent les principaux composants dans Measure et expliquent comment les utiliser efficacement lorsque vous analysez les performances du modèle.

Résumé du projet

La section Résumé fournit une vue rapide de haut niveau des performances de la version actuelle de votre modèle dans l’ensemble du projet. Vous pouvez l’utiliser pour :

- Sélectionnez la version du modèle que vous souhaitez évaluer.

- Obtenez un aperçu rapide des performances globales grâce au Score du projet et au Taux d’erreur moyen du document.

- Repérez rapidement si les performances globales du projet sont à la hausse ou à la baisse lors de la comparaison avec une version précédente.

Score du projet

Le score du projet résume les performances globales du modèle.

Pourquoi cela est-il utile ?

- Fournit un moyen unique et cohérent de suivre la progression globale lorsque vous itérez sur la taxonomie, les instructions et les annotations.

- Vous aide à déterminer rapidement si une version du modèle s’améliore généralement ou régresse avant d’explorer des champs spécifiques.

Comment cela est-il calculé ?

- Le score du projet est calculé comme la moyenne simple des scores F1 sur tous les champs de la taxonomie.

- Le score F1 est une métrique de performance du modèle standard qui équilibre la précision et le rappel, c’est-à-dire la moyenne harmonique des deux.

- À un niveau élevé :

- Réponses de précision : à quelle fréquence les valeurs prédites du modèle étaient-elles correctes ?

- Réponses concernant le rappel : quelle proportion des données annotées le modèle a-t-il réussi à identifier ?

Le score du projet est une moyenne. Les régressions ou les limitations spécifiques au niveau du champ peuvent être examinées à l’aide de la table de Performances du champ.

Taux d’erreur moyen du document

Le taux d’erreur moyen du document est la moyenne des taux d’erreur pour chaque document annoté dans le projet.

Pourquoi cela est-il utile ?

Le taux d’erreur moyen du document fournit un indicateur rapide de la tendance à l’erreur des documents lorsque la version du modèle sélectionné les traite, ce qui aide à évaluer l'état de préparation à la publication.

Comment cela est-il calculé ?

La valeur est calculée comme la moyenne simple du taux d'erreur de chaque document entièrement annoté dans le projet.

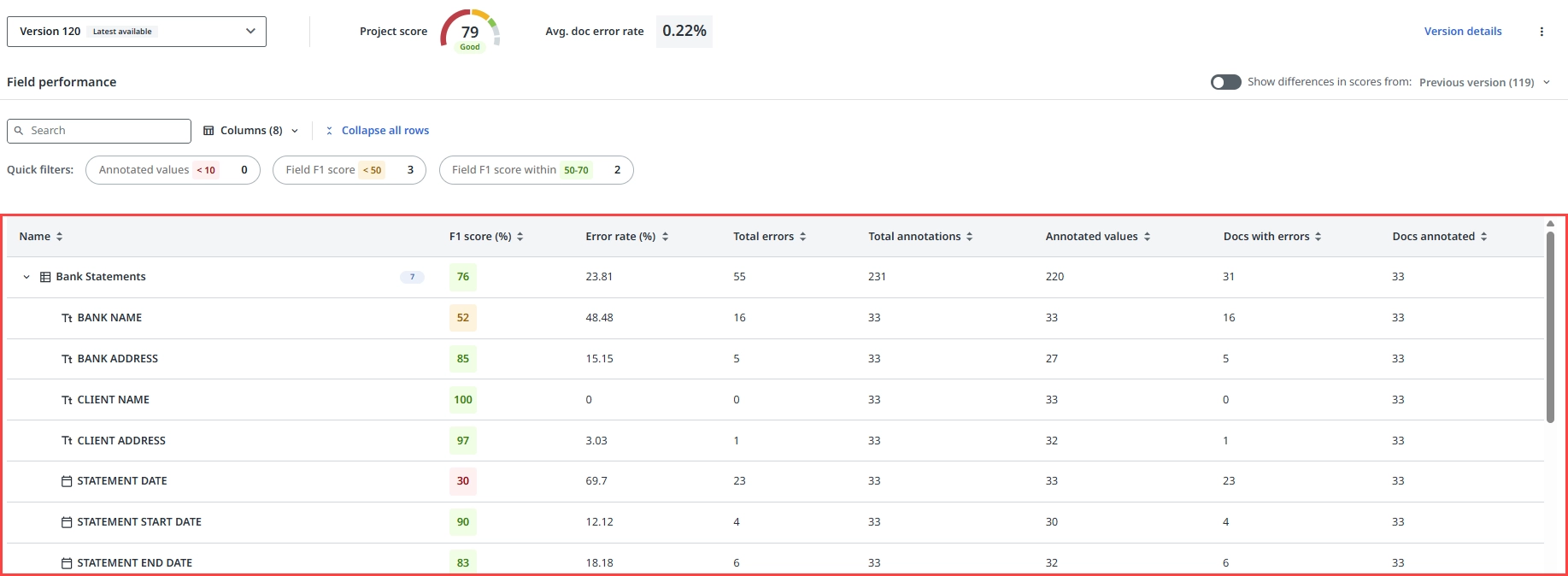

Table des performances du champ

La table Performances du champ est le principal moyen d’analyser les performances du modèle dans la page Measure. Elle affiche une ligne par champ ou groupe de champs, ainsi que les métriques de performances et d'erreur calculées sur les documents annotés dans le projet. La table ne prend pas en compte les documents non annotés et partiellement annotés lors du calcul des métriques.

La table aide à répondre à des questions telles que :

- Quels champs limitent les performances globales du modèle ?

- Les erreurs sont-elles concentrées dans quelques champs ou largement réparties ?

- Une modification récente du modèle a-t-elle amélioré ou dégradé des champs spécifiques ?

La table Performances du champ inclut plusieurs catégories de métriques qui vous aident à analyser les performances du modèle sous différentes perspectives. Chaque catégorie répond à une question de diagnostic spécifique sur le comportement de votre modèle dans les champs et les documents.

Statut de la validation et résultats partiels Pour réduire le temps d’attente :

- Les métriques de performances du champ deviennent visibles une fois que la validation atteint un seuil d’achèvement minimum.

- Les avertissements indiquent que la validation est toujours en cours et que les résultats affichés peuvent changer.

Métriques de performances

Le but des métriques de performances est d’évaluer la qualité globale de l’extraction pour chaque champ ou groupe de champs.

Les métriques de performances sont décrites comme suit :

- Score F1 - La moyenne harmonique de la précision et du rappel : F1 = 2 × (précision × rappel) / (précision + rappel). Le score F1 ne reste élevé que lorsque la précision et le rappel sont tous deux élevés. En pratique, cela fait de F1 un indicateur de qualité globale fort pour les tâches d’extraction où vous vous souciez d’éviter des valeurs incorrectes et des valeurs manquées. Par conséquent, F1 est une première métrique utile à examiner pour analyser les modifications de performances du champ sur les versions de modèle.

- Précision - Mesure la fréquence à laquelle les valeurs prédites sont correctes : précision = vrais positifs / (vrais positifs + faux positifs). Les vrais positifs sont des prédictions qui correspondent à la valeur annotée, à l’exclusion des valeurs annotées comme manquantes.

- Rappel - Mesure la fréquence à laquelle le modèle trouve une valeur lorsqu'elle existe : Rappel = Vrais positifs / (Vrais positifs + Faux négatifs). Les faux négatifs sont des valeurs annotées que le modèle n’a pas prédit, à l’exclusion des valeurs annotées comme manquantes.

- Taux d’erreurr - Erreurs totales / Annotations totales. Les valeurs marquées comme manquantes sont incluses dans le nombre d’erreurs et d’annotations.

- Taux d’Error (à l’exclusion des éléments manquants) - (Erreurs totales - Prédictions supplémentaires) / Valeurs annotées. Les valeurs annotées marquées comme manquantes sont exclues.

Prédictions et erreurs

Le but des métriques de prédictions et d’erreurs est de comprendre le volume et la composition des erreurs qui contribuent à de mauvaises performances.

Les métriques sont décrites comme suit :

- Erreurs totales - Nombre total d’erreurs pour un champ dans toutes les classes d’erreur : Erreurs totales = prédictions incorrectes + prédictions manquantes + prédictions supplémentaires.

- Total des prédictions - Nombre total de valeurs prédites pour un champ : Total des prédictions = Valeurs correctes + Valeurs manquantes correctes + Prédictions incorrectes.

- Prédictions incorrectes - Nombre de prédictions où la valeur extraite ne correspond pas à l’annotation. Exclut les prédictions et les valeurs annotées marquées comme manquantes.

- Prédictions supplémentaires - Nombre de valeurs prédites que le modèle n’aurait pas dû extraire, ou pour lesquelles il n'existait pas d’annotation correspondante ou d’annotation marquée comme manquante.

- Prédictions manquantes - Nombre de valeurs annotées que le modèle n’a pas réussi à extraire.

- Valeurs correctes - Nombre de valeurs prédites qui correspondent exactement à l’annotation.

- Valeurs manquantes correctes - Nombre d’instances où le modèle a correctement prédit qu’une valeur est manquante.

Annotations

Le but des métriques d’annotations est de fournir le contexte de la quantité de données étiquetées prises en charge par chaque métrique et de la fiabilité des scores de performances.

Les métriques sont décrites comme suit :

- Annotations totales - Nombre total d’annotations, y compris les valeurs marquées comme manquantes : total d’annotations = Valeurs annotées + Valeurs annotées marquées comme manquantes.

- Valeurs annotées - Nombre total de valeurs de champ annotées, à l’exclusion de celles marquées comme manquantes.

- Annoté comme manquant - Nombre total de fois qu’un champ a été explicitement étiqueté comme manquant.

Métriques au niveau du document

Le but des métriques au niveau du document est de comprendre comment les erreurs sont distribuées entre les documents plutôt que uniquement entre les prédictions.

Les métriques sont décrites comme suit :

- Documents avec des erreurs - Nombre total de documents où le champ contient au moins une erreur.

- Documents annotés - Nombre total de documents dans lesquels le champ a au moins une valeur de champ annotée.

- Pourcentage de documents avec des erreurs - Pourcentage de documents annotés qui contiennent au moins une erreur pour le champ : Documents avec des erreurs / Documents annotés.

Exemples de scénarios

Scénario 1 : F1 faible + Précision faible, mais le rappel est modéré ou élevé

Ce que vous observez

Le F1 est faible, la précision est faible et le rappel est modéré ou élevé.

Ce que cela signifie généralement

- Le modèle extrait les valeurs d’un champ, mais le nombre de valeurs prédites est supérieur à celui auquel vous vous attendiez.

- Causes profondes courantes :

- L’instruction du champ est trop large ou ambiguë. Par exemple, l’instruction du champ est de capturer le montant, mais elle ne spécifie pas quel montant.

- Le document a des valeurs similaires qui peuvent être confondues les unes avec les autres, par exemple, sous-total contre total, adresse de livraison contre adresse de facturation.

Que faire ensuite

Comparez les prédictions incorrectes et supplémentaires pour identifier si le problème est lié à l’extraction d’une valeur incorrecte (nombre de prédictions incorrectes non nul) ou si la valeur n’aurait pas dû être extraite du tout (nombre de prédictions supplémentaires non nul).

Affinez les instructions de champ à l'aide d'éléments permettant d'éviter toute ambiguïté, tels que des libellés, des mots-clés et des contraintes de formatage.

Scénario 2 : prédictions manquées élevées (le rappel est faible), la précision est modérée ou élevée

Ce que vous observez

- Le rappel est faible et la précision est modérée ou élevée (le F1 est généralement faible ou modéré).

- Les prédictions manquées sont élevées, souvent plus que celles qui sont erronées ou supplémentaires.

Ce que cela signifie généralement

- Le modèle ne parvient pas à extraire les valeurs qui sont présentes.

- Causes profondes courantes :

- Les instructions de champ sont trop étroites, ce qui signifie des exemples trop contraints ou des exigences de libellé trop spécifiques.

- La valeur apparaît dans plusieurs formats tels que les dates et les ID, et l’instruction ne couvre pas les variantes.

Que faire ensuite

- Utilisez Prédictions manquées + Valeurs annotées pour confirmer qu’il s’agit d’un problème de rappel, c’est-à-dire que les valeurs existent mais ne sont pas trouvées. Vérifiez Valeurs annotées pour confirmer qu’il existe un nombre raisonnable de points de données annotés pour le champ, et Prédictions manquantes pour confirmer que le modèle a du mal à trouver des valeurs plutôt que de les prédire incorrectement.

- Développez les instructions pour inclure des variantes acceptables : libellés ou synonymes alternatifs, plusieurs schémas de formatage, indications de localisation (par exemple, près des détails du demandeur ou sous la section Emprunteur).

Scénario 3 : Taux d'erreur élevé, mais Documents faibles avec des erreurs (erreurs concentrées dans quelques documents)

Ce que vous observez

- Le taux d'erreur est élevé ou les erreurs totales sont élevées.

- Le nombre de documents avec des erreurs est faible par rapport au nombre de documents annotés.

- Souvent, un champ est mauvais, mais n'échoue que sur un petit sous-ensemble de documents.

Ce que cela signifie généralement

- Les erreurs sont déclenchées par des documents atypiques, et non par un comportement systémique du champ.

- Causes profondes courantes :

- Un document ou un format spécifique se comporte différemment du reste.

- Problèmes d’OCR ou de qualité dans un petit nombre de documents, tels que des numérisations floues, des superpositions inclinées et manuscrites.

- Le champ est présent dans la plupart des documents, mais formaté inhabituellement dans quelques-uns, par exemple, multi-lignes versus une seule ligne.

Que faire ensuite

- Comparez les Docs avec des erreurs et les Docs annotés, et facultativement % de Docs avec des erreurs pour confirmer la concentration.

- Triez les documents par Taux d’erreur dans la page Créer et inspectez les documents présentant le taux d’erreur le plus élevé pour identifier si le champ fonctionne mal sur un sous-ensemble spécifique.

Scénario 4 : fluctuations importantes des performances entre les versions avec peu d’annotations

Ce que vous observez

- De grandes différences dans le F1 ou le taux d’erreur entre les versions du modèle (vers le haut ou vers le bas), mais les Valeurs annotées sont faibles, les Docs annotés sont faibles, ou les deux.

Ce que cela signifie généralement

- Les métriques de champ ne sont pas encore stables en raison de la petite taille de l’échantillon.

- Causes profondes courantes :

- Trop peu d’exemples - 1 à 2 documents peuvent modifier de manière significative les taux.

- Le champ est rarement présent, c’est-à-dire de nombreux incidents manquants et peu de valeurs vraies.

- Une poignée de documents difficiles domine la métrique.

Que faire ensuite

- Vérifiez les valeurs annotées, les docs annotés et ceux annotés comme manquants pour valider la faible couverture.

- Traitez les métriques comme directionnelles et non définitives jusqu’à ce que la couverture augmente.

- Ajoutez davantage de données étiquetées spécifiquement pour ce champ : priorisez les documents où le champ est présent et incluez un ensemble diversifié d’échantillons ou de variantes.

- Utilisez les comparaisons de versions uniquement après que la couverture est suffisante pour réduire le bruit induit par la variabilité.

Filtrage et tri

Pour filtrer les lignes dans la table, sélectionnez un ou plusieurs des filtres rapides disponibles :

- Valeurs annotées <10

- Score du champ F1 < 50

- Score de champ F1 dans les limites de 50–70

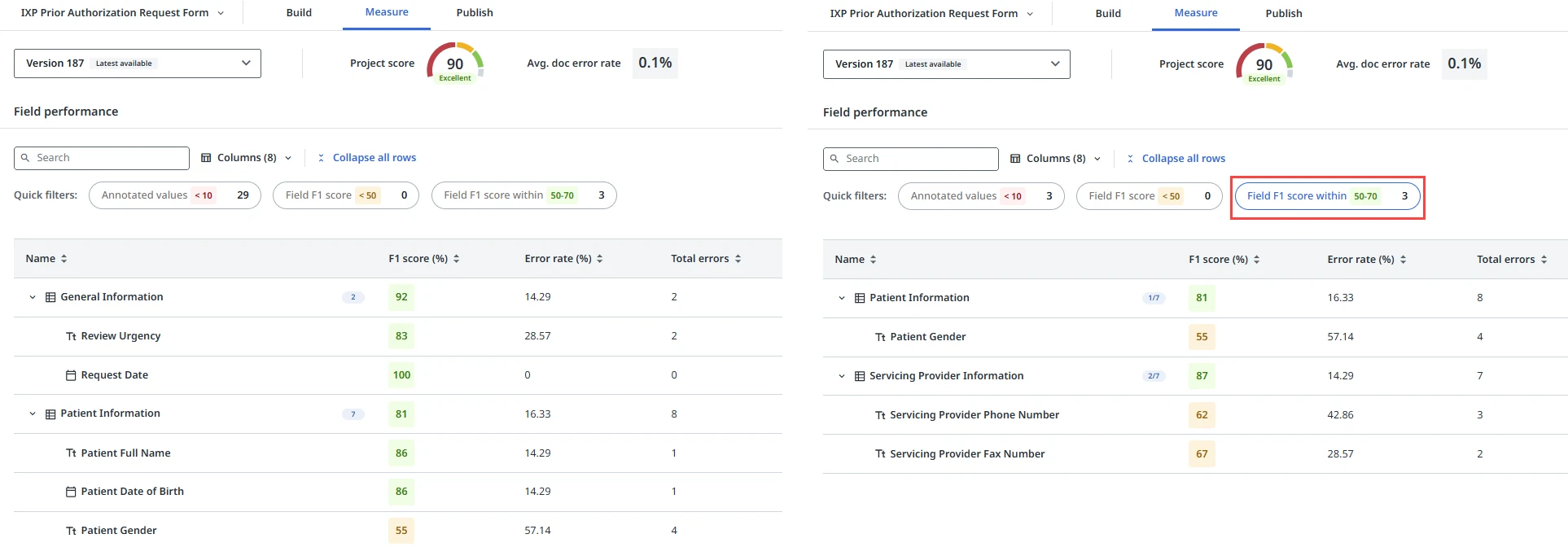

Les images suivantes représentent un exemple des résultats de la table Performances du champ avant et après l'application d'un filtre rapide :

Vous pouvez également trier la table Performances du champ par n’importe quelle métrique dans la table. Lorsqu’un tri est appliqué, les valeurs sont triées dans leur groupe de champs respectif. Par exemple, le tri de la table par score F1 trie les champs à l'intérieur de chaque groupe de champs les uns par rapport aux autres :

Paramètres de visibilité

Par défaut, Measure affiche les différences de métriques de performances, par exemple, le score F1 et le taux d’erreur.

Pour afficher les différences entre toutes les métriques, procédez comme suit :

-

Activez/désactivez l'option Afficher les différences de scores par rapport à : Version.

-

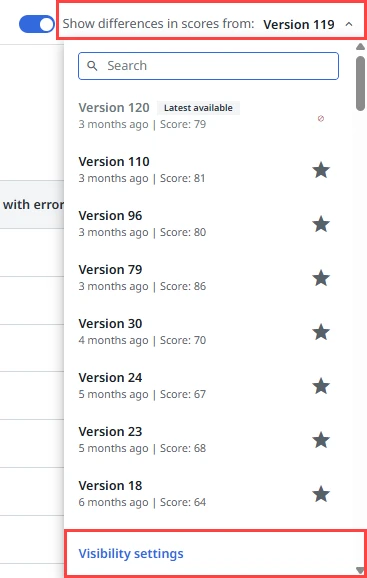

Sélectionnez la liste déroulante Afficher les différences de scores par rapport à : Version.

-

Sélectionnez Paramètres de visibilité.

-

Dans la fenêtre contextuelle Modifications de la version - paramètres de visibilité, sélectionnez Toutes les métriques. Les options disponibles sont :

- Métriques de performances uniquement - Les métriques de performances sont celles déterminées par les prédictions du modèle, une fois comparées aux annotations. Elles comprennent le score F1 et le taux d’erreur.

- Toutes les métriques

- Afficher les modifications à l’intérieur de la variabilité du modèle - Par défaut, les modifications dans les plages de variabilité de la version actuelle ne sont pas considérées comme significatives et sont masquées. Activez cette option pour les afficher. Lorsqu’elle est sélectionnée, l’option suivante devient disponible :

- Afficher les couleurs de toutes les modifications - Par défaut, les modifications dans la plage de variabilité apparaissent en gris. Activez cette option pour afficher toutes les modifications en vert ou en rouge.

-

Sélectionnez Enregistrer.

Versions de modèles

Les versions des modèles capturent l'état actuel du projet au moment où la version a été créée. Vous pouvez publier des versions du modèle pour les enregistrer et les utiliser dans une automatisation. En outre, vous pouvez marquer les versions dans la page Measure pour enregistrer leurs statistiques de performances. Vous pouvez comparer les performances actuelles par rapport aux versions précédentes pour garantir l’amélioration continue des performances pendant l’itération des instructions.

Sélection d'une version de modèle

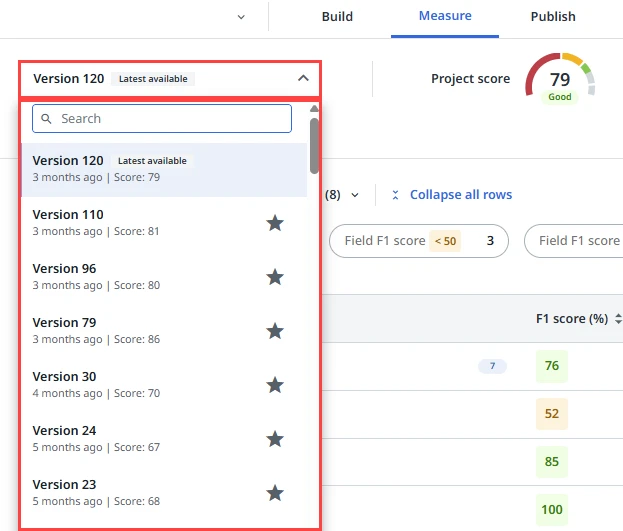

Utilisez la liste déroulante Version pour choisir les résultats de la validation d’une version spécifique du modèle qui sont affichés sur la page Measure, tels que les performances du champ, les performances du document et les métriques associées. Lorsque vous changez de version du modèle, toutes les métriques sur la page sont mises à jour pour refléter les résultats de la validation de la version sélectionnée.

Comparaison de différentes versions de modèle à l’aide de différences de score

Lorsque plusieurs versions de modèle sont disponibles, la page Measure vous permet de comparer le modèle actuel à une version précédente. De cette façon, vous pouvez mieux comprendre l’impact des modifications apportées aux instructions de champ, des changements dans les annotations ou des mises à jour de la configuration du modèle.

Mode de fonctionnement

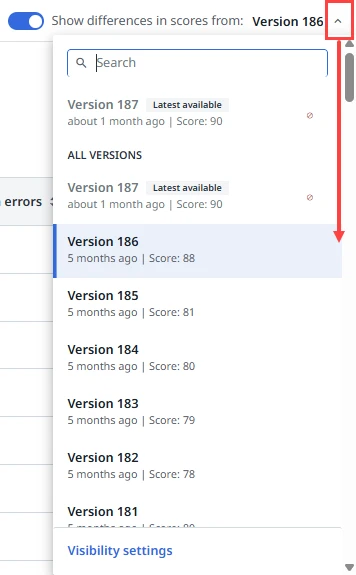

- Measure vous permet d’afficher les différences de score par rapport à une autre version du modèle.

- Les modifications positives ou négatives mettent en évidence les améliorations ou les régressions. Par défaut, Measure effectue des comparaisons avec la version précédente du modèle par rapport à la version du modèle la plus récemment créée.

Pour comparer une version différente du modèle, sélectionnez une version disponible à l’aide de la liste déroulante Afficher les différences de scores de la version.

Compréhension de la variabilité du modèle et de l’impact sur les différences de score

Certains modèles dans Extraction et traitement intelligents (IXP) sont non déterministes, ce qui signifie que l’ensemble de prédictions d’un champ entre les versions de modèle peut varier légèrement même lorsque les instructions de ce champ sont inchangées.

La page Measure vous permet de prendre en compte la variabilité du modèle pendant l’analyse des performances. Cela vous aide à :

- Comprendre si une modification des performances est significative.

- Évitez de surinterpréter de petites fluctuations métriques.

Par défaut :

- Les différences de score qui entrent dans la plage de variabilité d’une métrique sont masquées lors de la comparaison de deux versions de modèle.

- Vous pouvez sélectionner d’afficher toutes les différences de score ou uniquement les différences qui sont supérieures ou égales à la variabilité d’une métrique.

Ces valeurs par défaut garantissent que l’attention est concentrée sur les modifications significatives des performances du modèle et non sur le bruit.

Pour afficher les différences entre les versions du modèle, quelle que soit la variabilité de celui-ci, procédez comme suit :

- Activez/désactivez l'option Afficher les différences de scores par rapport à : Version.

- Sélectionnez la liste déroulante Afficher les différences de scores par rapport à : Version.

- Sélectionnez Paramètres de visibilité.

- Dans la fenêtre contextuelle, sélectionnez Afficher les modifications à l’intérieur de la variabilité du modèle. Les options disponibles sont :

- Métriques de performances uniquement - Les métriques de performances sont celles déterminées par les prédictions du modèle, une fois comparées aux annotations. Elles comprennent le score F1 et le taux d’erreur.

- Toutes les métriques

- Afficher les modifications à l’intérieur de la variabilité du modèle - Par défaut, les modifications dans les plages de variabilité de la version actuelle ne sont pas considérées comme significatives et sont masquées. Activez cette option pour les afficher. Lorsqu’elle est sélectionnée, l’option suivante devient disponible :

- Afficher les couleurs de toutes les modifications - Par défaut, les modifications dans la plage de variabilité apparaissent en gris. Activez cette option pour afficher toutes les modifications en vert ou en rouge.

- Vous pouvez éventuellement sélectionner Afficher les couleurs de toutes les différences si vous souhaitez que toutes les différences de score apparaissent en vert ou en rouge. Par défaut, les différences au sein de la plage de variabilité sont affichées en gris.

- Sélectionnez Enregistrer.

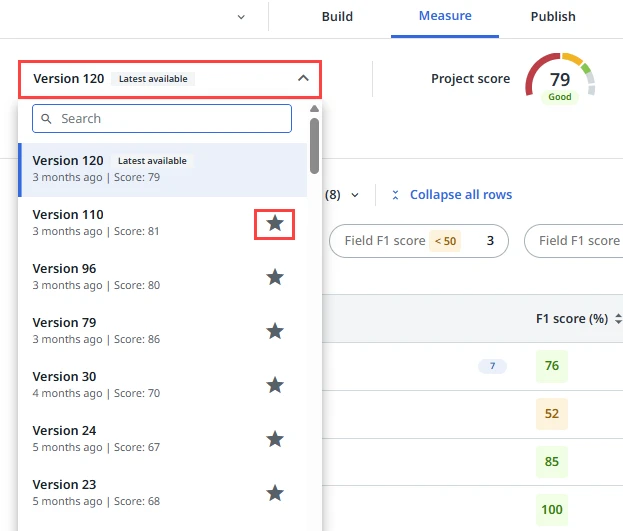

Épinglage d'une version de modèle

Une nouvelle version de modèle est créée chaque fois que vous modifiez votre taxonomie, y compris les instructions ou les paramètres du modèle. La dernière version du modèle est toujours disponible, mais vous pouvez également verrouiller une version spécifique du modèle pour toujours afficher les statistiques de performances dans le tableau de bord.

Pour épingler une version de modèle, procédez comme suit :

- Développez le menu déroulant Version du modèle pour afficher la liste de toutes les versions disponibles.

- Sélectionnez l'icône en étoile en regard de la version du modèle que vous souhaitez toujours afficher en haut de la liste et sur le tableau de bord.

Le démarrage d'une version de modèle n'enregistre pas la version du modèle elle-même, mais uniquement les statistiques de performances. Pour enregistrer une version de modèle, celle-ci doit être publiée dans l'onglet Publier .

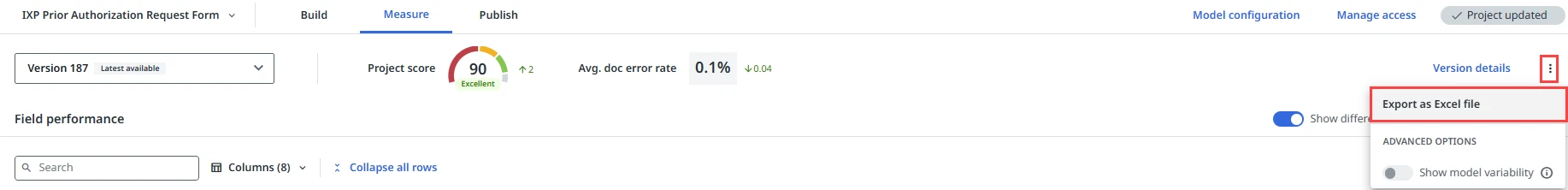

Exportation des données Measure

Vous pouvez exporter des données à partir de la page Measure pour :

- Analyse hors ligne.

- Filtrage personnalisé.

- Partage des résultats avec les parties prenantes.

Les exportations incluent des prédictions au niveau du champ, des annotations et des métriques de performances visibles dans la page Measure.

Pour exporter des données, procédez comme suit :

- Naviguez vers la page Measure.

- Sélectionnez l’ellipse verticale.

- Sélectionnez Exporter en tant que fichier Excel.

- Évaluation des performances du modèle dans Construire

- Évaluation des performances du modèle dans Mesurer

- Résumé du projet

- Table des performances du champ

- Versions de modèles

- Sélection d'une version de modèle

- Comparaison de différentes versions de modèle à l’aide de différences de score

- Épinglage d'une version de modèle

- Exportation des données Measure